Visual Intelligence: El plan secreto de Apple para eliminar la pantalla en 2027

Apple siempre ha sabido contar la tecnología como una extensión de la vida cotidiana, no como un simple gadget. Sin embargo, en las últimas semanas, se está vislumbrando un cambio: la IA ya no está solo en tus aplicaciones, está comenzando a convertirse en un sentido.

En su última newsletter, Mark Gurman (Bloomberg) describe a una Apple que está reorientando sus esfuerzos hacia la Visual Intelligence — una IA capaz de entender el contexto visual, los lugares, los objetos y las situaciones. Con una ambición clara: sacar la IA del teléfono y convertirla en el núcleo de una nueva generación de dispositivos wearables.

De la «búsqueda visual» a la asistencia en tiempo real

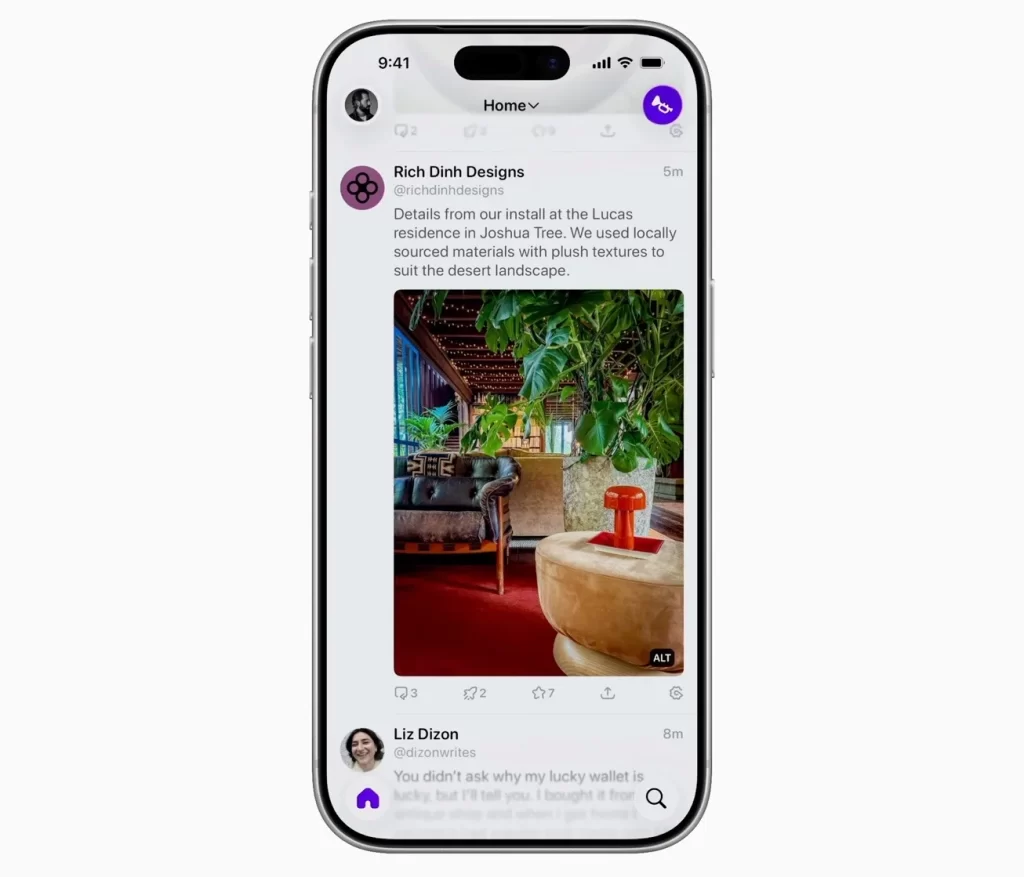

Hoy en día, Apple ya ha puesto una primera piedra: la Visual Intelligence permite buscar, hacer preguntas y actuar a partir de lo que ves (incluso a partir de lo que aparece en la pantalla), como transformar un cartel en un evento de calendario.

Sin embargo, Gurman habla de un cambio de naturaleza: pasar de «tomo una foto y pregunto» a «el dispositivo entiende de forma continua». Un ejemplo típico: en lugar de decirte «camina 150 metros», el asistente te dice «gira a la izquierda después del Starbucks». Esto es navegación… pero sobre todo navegación contextual, anclada en la realidad.

Tres formatos en desarrollo: gafas, colgante y AirPods «aumentados»

Según Bloomberg, Apple está acelerando el desarrollo de tres objetos que aprovecharían esta Visual Intelligence, con Siri como interfaz principal:

- Gafas inteligentes (sin pantalla, según el informe): cámaras, micrófonos, altavoces, y una IA capaz de reconocer el entorno, ayudar a orientarse, identificar elementos, traducir, etc. Producción prevista para finales de 2026, lanzamiento posible en 2027.

- Un colgante/pin IA: un pequeño módulo tipo AirTag que se puede llevar al cuello o en la ropa, con cámara + micrófono, pensado como los «ojos y oídos» del iPhone.

- AirPods con cámaras: no para grabar, sino para proporcionar a Siri una lectura del contexto (gestos, entorno, orientación), con pistas que sugieren sensores como infrarrojos.

La IA «en la pantalla» está comenzando a alcanzar su límite. Los asistentes han aprendido a responder; el siguiente paso es entender antes de que se pregunte. Y, para entender, se necesitan sensores, lo que significa objetos que se llevan, posicionan y están presentes. Bloomberg explica adecuadamente que Apple quiere hacer de la Visual Intelligence el símbolo de una nueva categoría para ponerse al día con el ritmo de la industria en IA ambiental.

El paradoja: menos pantallas… pero más invasión potencial

Hay una promesa atractiva: reducir el tiempo pasado mirando un rectángulo. Pero también hay un costo inmediato: la intrusión. Cámaras y micrófonos «más cerca» solo son aceptables si Apple logra su trío habitual:

- Control (interruptores, indicadores claros, permisos comprensibles)

- Procesamiento local siempre que sea posible (Apple ya insiste firmemente en la privacidad de su enfoque de Inteligencia de Apple).

- Utilidad diaria (no solo demostraciones): navegación, accesibilidad, traducción, reconocimiento de lugares/objetos, rutinas realmente pertinentes.

Todo esto es lo que determinará la aceptación: Apple puede vender un futuro de «menos pantallas» únicamente si el objeto es más discreto y no más invasivo.

El verdadero producto no es el colgante, es una nueva interfaz

El colgante puede parecer un simple gadget… hasta que lo consideremos como el Apple Watch en 2015: un «objeto extraño» que encuentra su lugar cuando la interfaz es buena. Pero, en este caso, lo fundamental no es la forma: es el cambio hacia una IA que ve, contextualiza y actúa.

Las gafas, por otro lado, son la apuesta más coherente: si Apple logra hacer monturas deseables y casi normales, la Visual Intelligence se convierte en una capa de asistencia permanente — sin necesidad de sacar el teléfono. Y si esto ocurre, no será «un gadget más»: será el comienzo de un mundo donde la interfaz se desplaza del pulgar… hacia la mirada.