Instagram alertará a los padres en caso de búsquedas relacionadas con el suicidio entre los adolescentes

La moderación en las redes sociales entra en una nueva fase. A partir de la próxima semana, Meta activará un sistema de alertas para padres en Instagram que notificará sobre búsquedas repetidas relacionadas con el suicidio o la autolesión en adolescentes.

Se prevé una extensión similar para los chatbots de IA del grupo.

Detrás de esta decisión hay una creciente presión regulatoria y una voluntad de anticipar los riesgos antes de que se conviertan en críticos.

Instagram: Una alerta desencadenada por búsquedas repetidas

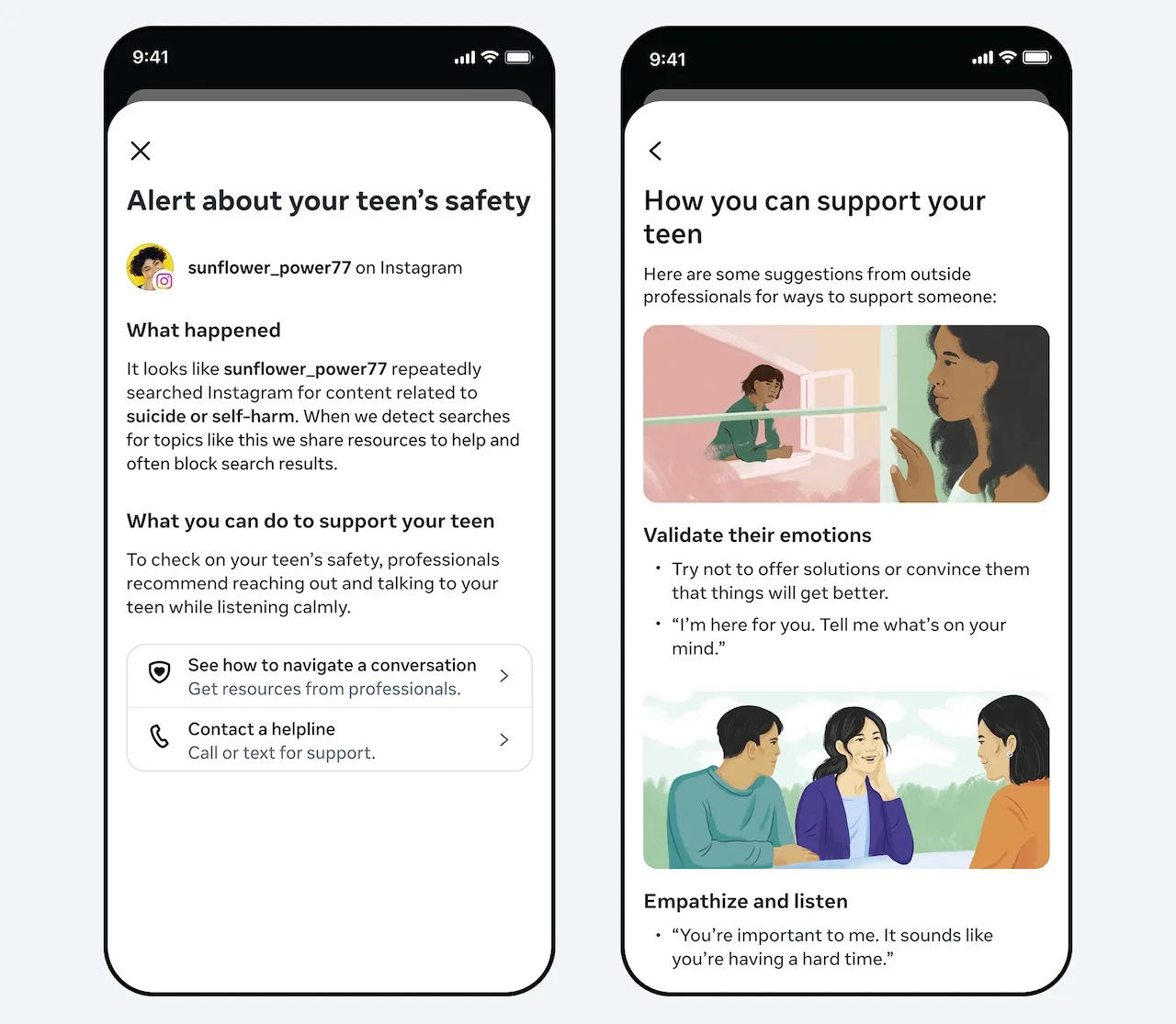

El dispositivo afecta exclusivamente a las cuentas de adolescentes bajo supervisión parental. Si un adolescente intenta, en múltiples ocasiones y en un corto periodo, buscar términos « claramente asociados » al suicidio o la autolesión, se enviará una notificación a los padres.

El sistema se desplegará la próxima semana en: Estados Unidos, Reino Unido, Australia y Canadá. Otras regiones seguirán más adelante en el año.

Meta aclara que la mayoría de los adolescentes no busca este tipo de contenido. Y cuando lo hacen, Instagram ya bloquea los resultados y redirige a recursos de ayuda y líneas de asistencia.

Por lo tanto, el objetivo no es la vigilancia masiva, sino intervenir cuando aparezca un patrón de comportamiento preocupante.

¿Cómo funcionan estas notificaciones?

Los padres recibirán: un correo electrónico, un SMS o un mensaje de WhatsApp (según los datos asociados a la cuenta). Una notificación dentro de la aplicación acompañará la alerta con recursos y consejos para abordar el tema con su hijo.

Meta insiste en un punto estratégico: evitar la sobredimensión de las notificaciones. Demasiadas alertas podrían banalizar la señal y reducir su efectividad.

Una extensión para chatbots de IA en preparación

Meta también anuncia que un sistema análogo se aplicará a sus chatbots de IA más adelante este año. Esto significa que las interacciones con los asistentes de conversación también podrían desencadenar alertas parentales en caso de contenidos sensibles.

En un contexto donde los jóvenes utilizan cada vez más la IA para hacer preguntas íntimas o psicológicas, la medida anticipa un desplazamiento del riesgo: la búsqueda ya no pasa únicamente por la barra de búsqueda, sino también a través de las conversaciones.

¿Seguridad reforzada o vigilancia aumentada?

Esta evolución se da en un clima regulatorio tenso. Las plataformas enfrentan críticas crecientes sobre la salud mental de los adolescentes, especialmente en Estados Unidos y Europa.

Meta adopta aquí un enfoque híbrido:

- Bloqueo automático de contenido sensible

- Redirección hacia ayuda

- Implicación parental específica

- Detección de comportamiento en lugar de alerta aislada

Técnicamente, esto supone un análisis semántico avanzado de las consultas y una detección de repetición contextual —probablemente apoyada por modelos de IA internos. La cuestión central sigue siendo el equilibrio entre prevención y privacidad. La decisión parental limita la intrusión, pero la dinámica de vigilancia algorítmica sigue intensificándose.

Lo que realmente muestra este anuncio es que la moderación ya no se limita a eliminar contenido: se vuelve predictiva, basada en el comportamiento y proactiva. Y esto redefine profundamente el papel de las plataformas sociales en la esfera familiar.