GPT-5.4 mini y nano: OpenAI hace que su IA sea más poderosa y asequible

OpenAI amplía su gama GPT-5.4 con dos nuevos modelos más ligeros: GPT-5.4 mini y GPT-5.4 nano. El objetivo es claro: llevar una parte significativa de las capacidades de GPT-5.4 a aplicaciones donde la latencia, el costo y el volumen son tan importantes como la inteligencia pura.

OpenAI presenta GPT-5.4 mini como su «mini-modelo más potente hasta el momento», mientras que nano se convierte en la opción más ligera y económica de la familia.

GPT-5.4 mini y nano: OpenAI apunta a aplicaciones donde cada milisegundo cuenta

Con estos dos modelos, OpenAI no está solo ampliando su catálogo. La empresa está abordando una necesidad muy concreta: la de los sistemas que deben responder rápidamente, con frecuencia y a gran escala. OpenAI menciona, por ejemplo, los asistentes de programación, los subagentes que ejecutan tareas en paralelo, los sistemas capaces de interpretar capturas de pantalla y las aplicaciones multimodales que deben razonar sobre imágenes en tiempo real.

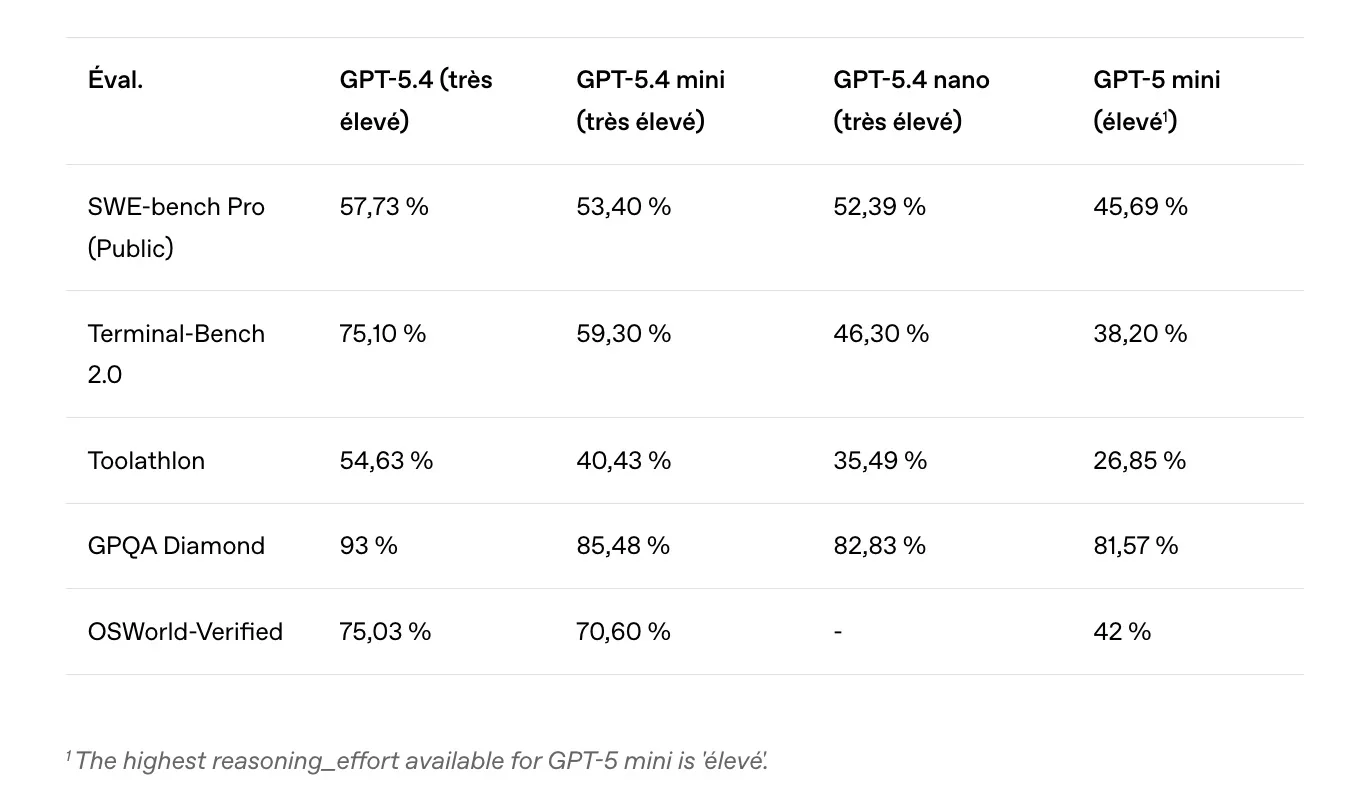

En esta línea, GPT-5.4 mini está posicionado como un compromiso muy agresivo entre velocidad y nivel de rendimiento. OpenAI afirma que ofrece mejoras en programación, razonamiento, comprensión multimodal y uso de herramientas, funcionando a una velocidad anunciada como superior a 2x.

Además, la compañía menciona que se acerca al rendimiento de GPT-5.4 en evaluaciones como SWE-Bench Pro y OSWorld-Verified.

GPT-5.4 nano, el modelo diseñado para la eficiencia pura

Por su parte, GPT-5.4 nano tiene un enfoque diferente. OpenAI lo describe como su modelo más pequeño de GPT-5.4, optimizado para tareas donde la rapidez y el costo son prioridades. Se presenta como particularmente adecuado para clasificación, extracción de datos, ranking, o para subagentes de código que manejan tareas más simples.

En otras palabras, OpenAI aquí afina su estrategia de producto. Mientras que GPT-5.4 está pensado para trabajos complejos y exigentes, mini y nano ocupan las capas operativas donde a menudo se prefiere una IA menos ambiciosa, pero mucho más rápida y significativamente más barata. Esta interpretación es un análisis del posicionamiento tarifario y funcional descrito por OpenAI.

El verdadero campo de batalla: código, agentes y multimodal ligero

OpenAI enfatiza especialmente tres áreas de uso. Primero, la programación, con flujos de trabajo de iteración rápida, modificaciones específicas, navegación en bases de código y ciclos de depuración más ágiles. Luego, los subagentes, en arquitecturas donde un modelo grande controla el conjunto mientras que modelos más pequeños realizan tareas específicas, como explorar una base de código o procesar documentos complementarios.

Finalmente, el uso de computadoras y el multimodal, donde se espera que GPT-5.4 mini interprete rápidamente interfaces visuales densas.

Este punto es crucial, ya que muestra cómo OpenAI ahora estructura su gama no solo por «nivel de inteligencia», sino por rol en una cadena de trabajo de IA. El gran modelo planifica. El pequeño modelo ejecuta. Y esta es, sin duda, una de las evoluciones más estratégicas del momento en las arquitecturas de agentes. Esta última frase se basa en una inferencia fundamentada en los casos de uso oficialmente destacados.

Precios, disponibilidad e integración en ChatGPT

En términos comerciales, GPT-5.4 mini está disponible en la API, en Codex y en ChatGPT. Su tarifa API está establecida en 0,75 dólares por millón de tokens de entrada y 4,50 dólares por millón de tokens de salida. GPT-5.4 nano, por otro lado, solo está disponible a través de la API, a 0,20 dólares por millón de tokens de entrada y 1,25 dólares por millón de tokens de salida.

OpenAI también aclara que, en Codex, GPT-5.4 mini consume el 30% del cupo de GPT-5.4, lo que permite delegar ciertas tareas simples a un costo menor. En ChatGPT, GPT-5.4 mini es accesible para los usuarios Free y Go a través de la función Thinking. Para los demás usuarios, también actúa como solución de respaldo cuando GPT-5.4 Thinking alcanza sus límites de capacidad.

Un lanzamiento que dice mucho sobre la madurez de la gama OpenAI

En el fondo, este anuncio revela algo más amplio que el simple lanzamiento de dos variantes. OpenAI está estructurando cada vez más su gama como una pila completa, donde cada modelo tiene una función económica y técnica precisa. GPT-5.4 para trabajos complejos. Mini para usos rápidos pero aún exigentes. Nano para tareas de soporte, masivas y sensibles al costo. Este análisis surge del posicionamiento comparativo de los modelos en las páginas oficiales de presentación y tarifación.

Esa es una evolución lógica. A medida que la IA deja de ser solo una demostración para entrar en la producción, la cuestión ya no es «¿qué modelo es el más inteligente?», sino «¿qué modelo es el más adecuado para cada etapa del sistema?». Y en este ámbito, GPT-5.4 mini y nano demuestran que OpenAI ahora quiere ganar tanto en arquitectura como en rendimiento puro.