GPT-5.3-Codex: OpenAI presenta su modelo de codificación más rápido para Codex

Hay anuncios que parecen ser «productos». Y luego están aquellos que parecen ser movimientos estratégicos, jugados en tiempo real ante toda la industria. El 5 de febrero, OpenAI lanzó GPT-5.3-Codex, un nuevo modelo diseñado para potenciar Codex — su herramienta de «agente de codificación» — solo unos minutos después de la salida del nuevo Claude Opus de Anthropic.

El detalle es intrigante: según TechCrunch, ambos laboratorios debían publicar al mismo tiempo, pero Anthropic habría adelantado su anuncio por 15 minutos.

Detrás de esta anécdota, el mensaje es claro: la batalla ya no es «quién codifica mejor», sino «quién construye la mejor fábrica de agentes».

GPT-5.3-Codex: una promesa de pasar de «copiloto» a «operador»

OpenAI presenta GPT-5.3-Codex como un salto cualitativo: Codex ya no se limitaría a «escribir y revisar código», sino que podría acercarse a lo que hacen los profesionales «en una computadora» — una forma de enfatizar la dimensión agente, es decir, la capacidad de encadenar acciones, utilizar herramientas y mantener una tarea a lo largo del tiempo.

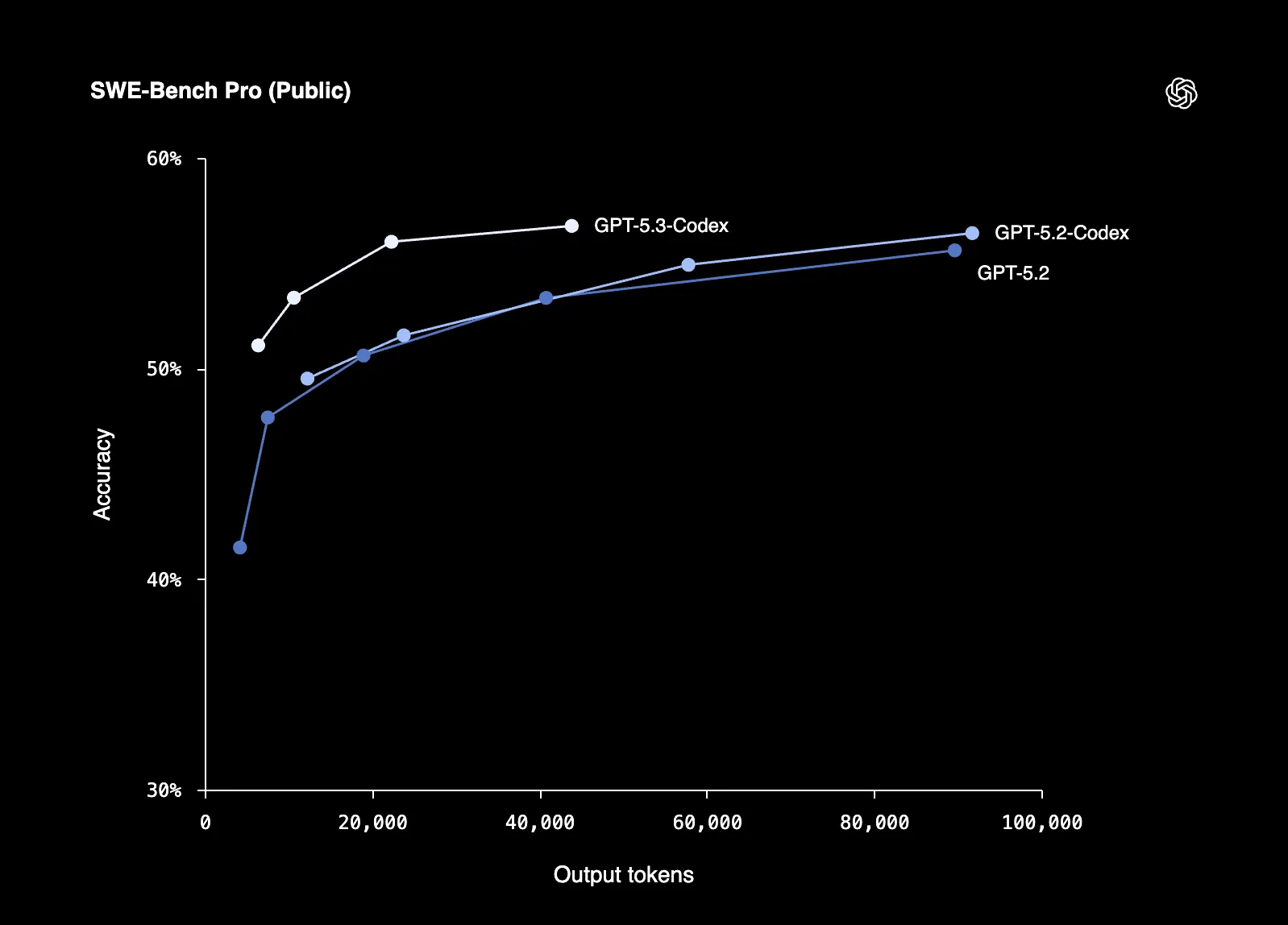

En su artículo oficial, OpenAI resume el objetivo: combinar el rendimiento «de codificación» de GPT-5.2-Codex con mayor razonamiento y conocimientos profesionales… todo mientras es un 25% más rápido para los usuarios de Codex.

La página «changelog» desarrolla la filosofía: mayor reactividad durante la ejecución, más retroalimentación sobre el progreso y una mejor capacidad para dejarse «guiar» en tiempo real.

El verdadero marcador: velocidad + resistencia, en lugar de «calidad bruta»

El núcleo de la guerra es el tiempo.

Donde los asistentes clásicos brillan en micro-tareas (autocompletar, fragmentos, refactorización específica), OpenAI busca trasladar el flujo de trabajo a una lógica de delegación: se confía un módulo, una característica, o incluso un mini-producto, y se supervisa. Esta lógica ya se escuchó durante el lanzamiento de la aplicación Codex en macOS, pensada como un «centro de comando» para ejecutar varios agentes en paralelo.

GPT-5.3-Codex se inscribe exactamente en esta trayectoria: menos fricción, más paralelización, y sobre todo una promesa implícita: transformar al desarrollador en un gerente de agentes en lugar de un ejecutor.

«Instrumental en su propia creación»: la frase que busca impactar

TechCrunch destaca otro elemento muy «Silicon Valley»: OpenAI afirma que GPT-5.3-Codex es el primer modelo que ha sido «instrumental» en su propia creación, a través de versiones internas utilizadas para la depuración y evaluación.

Es importante interpretar esto como un marcador de madurez (la herramienta se vuelve lo suficientemente confiable como para participar en el ciclo de desarrollo), pero también como un mensaje de marketing dirigido al ecosistema empresarial: este modelo no es un prototipo, ya es una máquina de producción.

Frente a Anthropic: dos visiones, un mismo terreno

Anthropic, por su parte, impulsa Claude Opus 4.6 hacia la versatilidad del trabajo del conocimiento (documentos, hojas de cálculo, presentaciones) y sobre todo hacia el multi-agente a través de sus «equipos de agentes», con un contexto que puede llegar hasta 1 millón de tokens (en beta).

OpenAI responde menos con un «concepto» que con un upgrade de cadencia: más rápido, más resistente, mejor integrado al control (aplicaciones, flujos de trabajo). Se siente una carrera que se desplaza: del modelo al producto, y luego del producto a la plataforma.

La verdad es que esta guerra se juega como una batalla de sistemas operativos: quien haga que los agentes se integren de forma natural en el flujo de trabajo ganará — incluso con un modelo «simplemente muy bueno».