OpenAI lanza GPT-5.3-Codex-Spark en chips Cerebras: la velocidad como nueva arma (y una señal a Nvidia)

Hay anuncios que destacan por su potencia bruta y otros que revelan una obsesión más sutil: el tiempo de respuesta. El jueves, OpenAI presentó GPT-5.3-Codex-Spark, una variante «aligerada» de su modelo de código, diseñada para bucles de edición casi instantáneos — y lo más importante, utiliza la infraestructura de Cerebras, un socio inédito fuera del monopolio efectivo de las GPU de Nvidia.

GPT-5.3-Codex-Spark: un modelo hecho para la iteración en tiempo real

OpenAI describe a GPT-5.3-Codex-Spark como su primer modelo diseñado explícitamente para la «programación en tiempo real»: menos pesadez, más fluidez, para que el asistente mantenga el ritmo de un desarrollador que itera rápidamente. La promesa es espectacular: 15 veces más rápido, con una sensación de «casi instantáneo». OpenAI incluso menciona más de 1,000 tokens por segundo en sus condiciones óptimas.

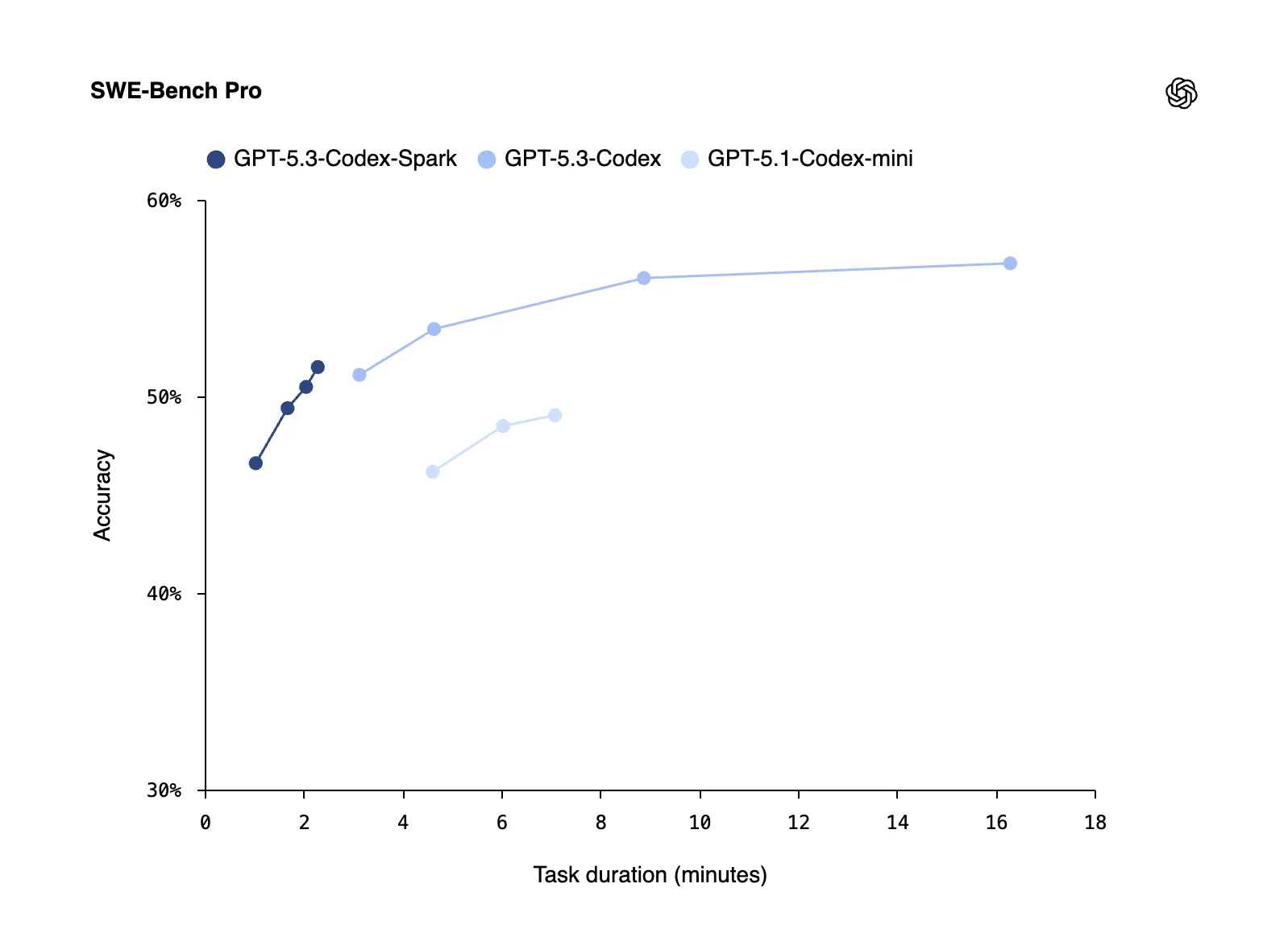

El inconveniente está asumido: en benchmarks como SWE-Bench Pro y Terminal-Bench 2.0, Codex-Spark se queda atrás respecto al GPT-5.3-Codex completo. En otras palabras, no será tan eficiente en tareas largas, multi-etapas y muy «agenciales», pero será más efectivo en la colaboración interactiva (correcciones, refactorización, pruebas rápidas, diálogos de código).

En uso, el modelo incluye un contexto de 128,000 tokens y se limita solo al modo texto (sin imagen, sin multimodalidad). Está disponible en vista preliminar de investigación para suscriptores de ChatGPT Pro a través de la app Codex, el CLI y la extensión de VS Code, mientras que la API está reservada inicialmente para un pequeño grupo de «socios de diseño».

¿Por qué Cerebras?: romper los cuellos de botella de la inferencia?

Este lanzamiento no es solo una cuestión de modelo; se trata de silicona. Cerebras presenta una tesis simple: para la inferencia de baja latencia, sus sistemas «wafer-scale» reducen los costos ocultos de la distribución en clusters de GPU (comunicación inter-chip, orquestación, sobrecarga).

La WSE-3 (Wafer-Scale Engine 3) — la vitrina tecnológica de Cerebras — presume de 4,000 millones de transistores y una lógica de «simplicidad de un solo dispositivo» que se enfoca precisamente en esos flujos de trabajo donde cada milisegundo cuenta.

En la narración oficial, OpenAI camina por la cuerda floja: «las GPU siguen siendo fundamentales«, pero Cerebras «complementa» todo el conjunto para casos de uso ultra-reactivos. Una formulación cautelosa… que se asemeja a la diplomacia industrial.

OpenAI también asegura haber acelerado toda su pila de inferencia — incluso fuera de Cerebras

Otro detalle revelador: OpenAI no limita su «caza de latencia» al hardware. En el mismo anuncio, la empresa afirma haber optimizado su pila (sesiones, streaming, transporte) a través de WebSocket persistente y mejoras en la Responses API:

- -80 % de sobrecarga por ida y vuelta cliente/servidor

- -30 % de sobrecarga por token

- -50 % en el tiempo hasta el primer token

Así, GPT-5.3-Codex-Spark es el producto bandera, pero el objetivo es más amplio: hacer que la experiencia de Codex sea más «en tiempo real» en todas partes, incluso en la infraestructura de GPU clásica.

El verdadero subtexto: OpenAI diversifica sus chips al momento en que el enfoque Nvidia se enfría

Si esta alianza es significativa, es porque llega tras un gran movimiento estratégico: OpenAI y Cerebras anunciaron en enero un acuerdo plurianual por hasta 750 MW de capacidad «ultra low-latency», implementada en varias fases.

Y este cambio también se puede leer como un reflejo de la situación de Nvidia. A finales de enero, Reuters reportó que el proyecto de inversión de Nvidia «de hasta 100,000 millones de dólares» en OpenAI había ralentizado, antes de que Jensen Huang minimizara públicamente cualquier «drama».

Agregue a esto las asociaciones anunciadas con AMD (despliegue de GPU a partir de 2026) y el trabajo con Broadcom en aceleradores personalizados, y la trayectoria se vuelve clara: OpenAI quiere evitar la dependencia de un solo proveedor, especialmente en la inferencia.

En un contexto eléctrico: publicidad, Pentágono y turbulencias internas

Este lanzamiento técnico ocurre también en medio de una secuencia política y reputacional cargada.

OpenAI acaba de comenzar una prueba de publicidad en ChatGPT (Free y Go, en EE. UU.), con la promesa de que los anuncios no influenciarán las respuestas. La empresa también ha confirmado el despliegue de una versión de ChatGPT en GenAI.mil para usos no clasificados del Departamento de Defensa.

En este escenario, GPT-5.3-Codex-Spark parece ser tanto una innovación de producto como un mensaje: OpenAI quiere recuperar la iniciativa sobre la experiencia — y demostrar que la competencia se jugará a partir de la sensación de uso, no solo en la magnitud de los modelos.

Lo que esto cambia para los desarrolladores (si la promesa se cumple)

La pregunta final es casi prosaica: ¿significa «más rápido» que «más productivo»? OpenAI apuesta que sí: cuando la latencia se reduce drásticamente, el asistente deja de ser una «petición» y se convierte en un socio de iteración — un copiloto que sigue el ritmo del teclado.

Si la inferencia de ultra baja latencia se generaliza, el ganador no será necesariamente quien escriba el mejor código «a la primera», sino quien haga que el intercambio humano-IA sea adictivamente fluido. Y, en esta carrera, Cerebras acaba de obtener su primer papel protagónico.