Copilot Health : Microsoft lanza un asistente IA dedicado para decodificar sus archivos médicos

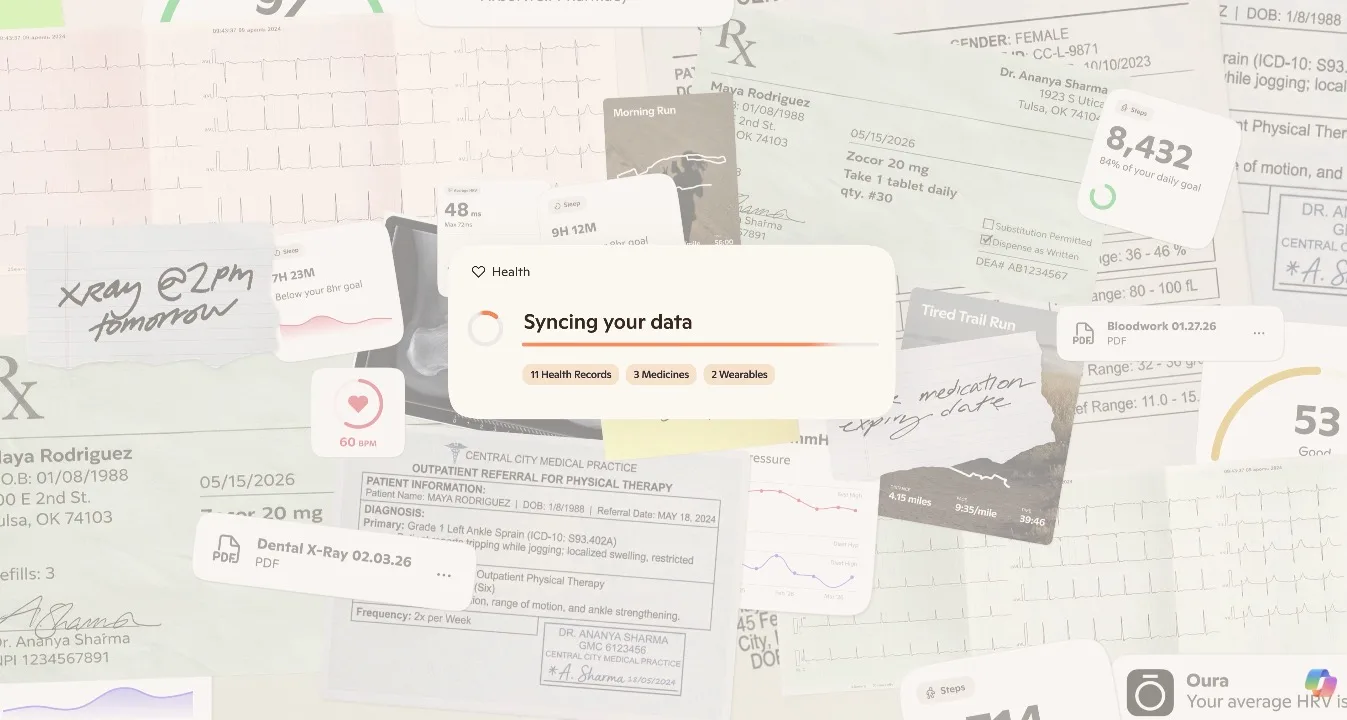

Microsoft acaba de anunciar Copilot Health, un espacio separado dentro de Copilot dedicado a las cuestiones de salud: entender los resultados de laboratorio, decodificar un expediente médico, cruzar datos de dispositivos portátiles o buscar un profesional de salud. El acceso se realizará de manera gradual mediante un despliegue por etapas, con lista de espera para los interesados.

En teoría, es exactamente lo que muchos esperaban: un asistente capaz de explicar sus datos, sin perderse en la jerga y sin tener que hacer clic en diez pestañas de foros.

Un Copilot «apartado»: importación de expedientes, laboratorios y wearables

Microsoft subraya un punto: Copilot Health no reemplaza a un médico y no tiene como objetivo realizar diagnósticos ni prescribir tratamientos. El objetivo declarado es ayudar al usuario a comprender mejor su información de salud.

Concretamente, Copilot Health puede:

- Importar expedientes médicos de más de 50,000 hospitales y organizaciones de salud en Estados Unidos a través de HealthEx.

- Importar resultados de pruebas a través de Function (integración de laboratorio).

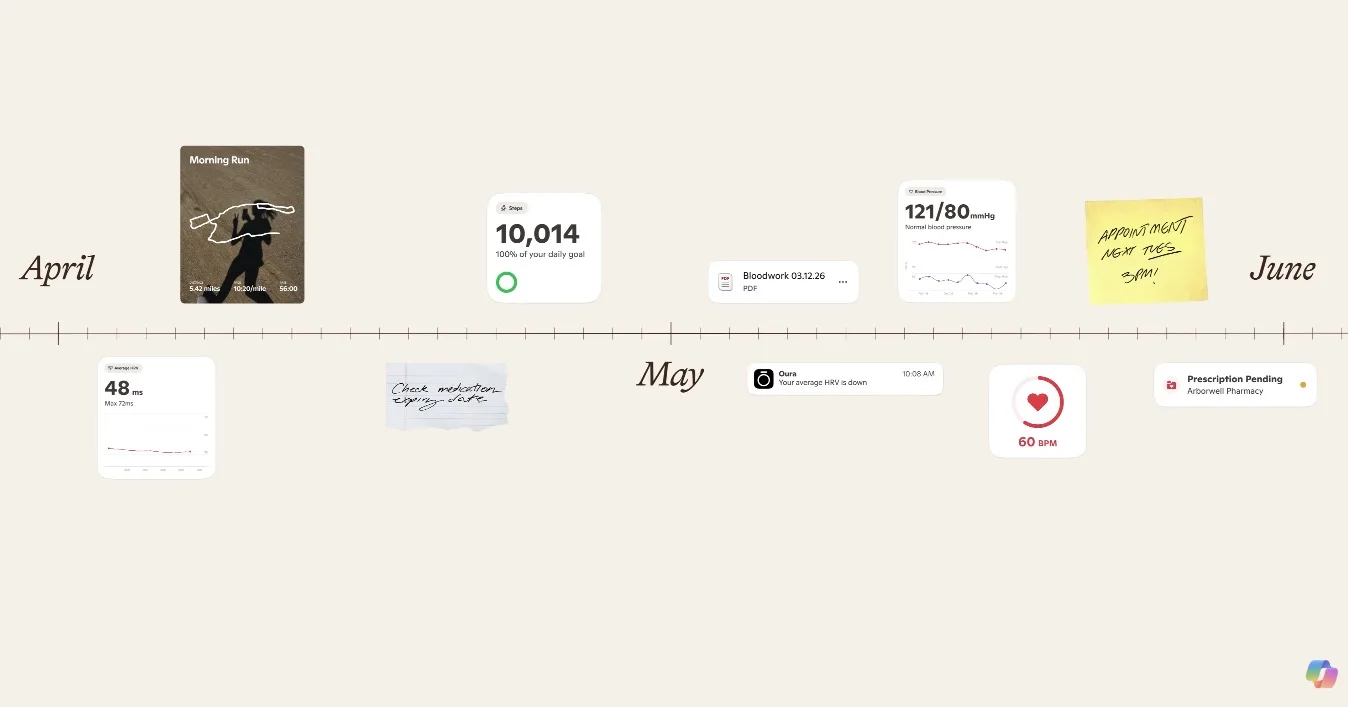

- Conectarse a más de 50 dispositivos portátiles (Apple, Oura, Fitbit, etc.) para mostrar métricas (pasos, tendencias, recordatorios, citas) según los datos que el usuario acepte compartir.

- Buscar profesionales a través de directorios «en tiempo real» (especialidad, ubicación, idiomas, seguros).

El posicionamiento es claro: Copilot Health quiere convertirse en una capa de legibilidad entre sus datos (a menudo dispersos) y su capacidad para hacer algo comprensible con ellos.

«Respuestas más fiables»: citas y mapas de Harvard Health

Microsoft también intenta abordar la crítica más frecuente sobre la IA en salud: la fiabilidad. La empresa afirma que «eleva» la información de organizaciones de salud creíbles y anuncia respuestas con citas y cartas de respuesta redactadas por expertos de Harvard Health.

Es una buena señal, pero no resuelve todo: incluso con fuentes, la IA puede malinterpretar un contexto, generalizar en exceso o tener demasiada confianza en una hipótesis. Las citas ayudan principalmente a auditar y a reaclarar.

Confidencialidad: aislamiento, control del usuario… pero debate sobre HIPAA

En cuanto a la confidencialidad, Microsoft destaca una arquitectura «compartimentada»: los chats de Copilot Health estarían aislados del Copilot general, sujetos a controles adicionales, no utilizados para el entrenamiento de los modelos, con posibilidad de eliminar los datos o desconectar las fuentes en cualquier momento.

Sin embargo, la línea más delicada está en otro lado: Copilot Health se presenta como una experiencia de consumo no compliant con HIPAA en esta etapa, a diferencia de algunos productos «compliant con HIPAA» en el mercado (Amazon Health AI y otras ofertas orientadas a organizaciones de diferentes actores). Microsoft responde con una matización legal: en el consumo directo, la empresa considera que HIPAA «no es necesario», aunque menciona «controles de HIPAA» futuros.

Para recordar, HIPAA es una ley estadounidense que busca hacer respetar la portabilidad y la responsabilidad en materia de seguros de salud. Exige que las empresas que manejan información de salud protegida hayan implementado y sigan medidas de seguridad físicas, de red y de procesos.

Por su parte, Microsoft subraya una certificación ISO/IEC 42001 (estándar de gestión para sistemas de IA), que supuestamente atestigua una gobernanza responsable y auditable.

Microsoft quiere ser su «intérprete», pero la confianza se construirá a largo plazo

El lanzamiento de Copilot Health confirma una tendencia en 2026: la IA de consumo se desplaza hacia espacios aislados para temas de alto riesgo (salud, finanzas), prometiendo la no utilización en entrenamiento, controles reforzados y conectores hacia datos personales. OpenAI ha lanzado un enfoque comparable con ChatGPT Health en enero, y Anthropic ha lanzado Claude for Healthcare.

La apuesta de Microsoft es coherente: si la IA se convierte en la «puerta de entrada» a la vida cotidiana, la salud es un uso masivo… y ansioso. Pero la verdadera prueba no será la interfaz: serán la estabilidad de las políticas, la claridad de lo que se recopila/almacena y la capacidad de evitar desviaciones (consejos inadecuados, sobreinterpretación, riesgos en salud mental).

Copilot Health puede ser una herramienta muy útil, siempre que se trate como un asistente para la comprensión, no como un árbitro médico.