Claude aprende a « soñar »: Anthropic quiere hacer que sus agentes de IA sean más coherentes a lo largo del tiempo

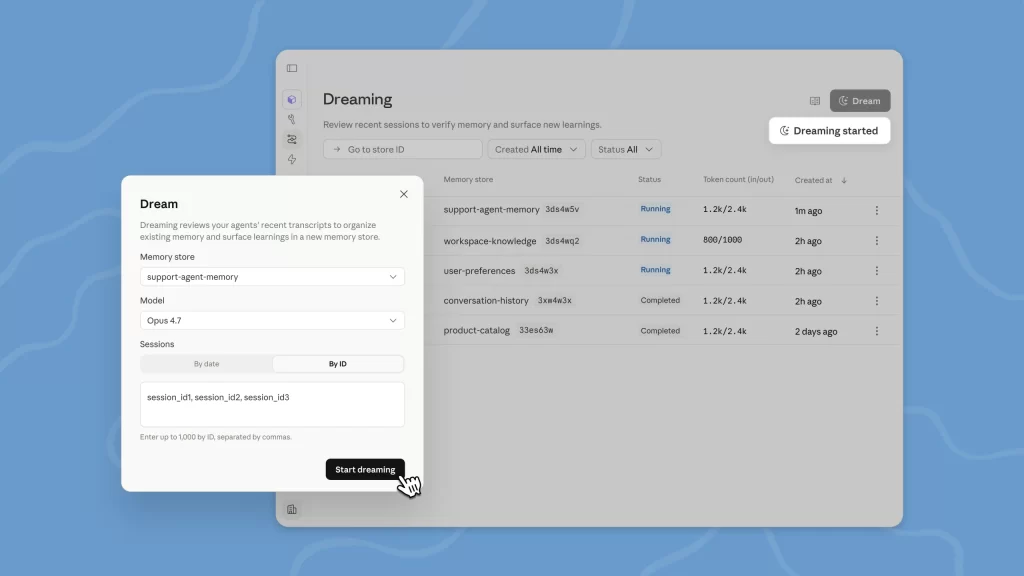

Anthropic ha añadido una función sorprendentemente llamada « soñando » a Claude Managed Agents. Detrás de este término poético, la idea es muy concreta: permitir que los agentes revisen sus sesiones anteriores, identifiquen información útil y organicen mejor su memoria para futuras tareas.

Una memoria más organizada para los agentes de IA

Presentada durante la conferencia Code with Claude, la función soñando llega en research preview en Claude Managed Agents. Analiza sesiones pasadas y memorias existentes para detectar patrones recurrentes, preferencias o errores repetidos, y conservar lo que realmente puede mejorar las próximas interacciones.

El objetivo es simple: evitar que los agentes acumulen recuerdos obsoletos, contradictorios o redundantes a lo largo de proyectos prolongados.

Más que un simple resumen de conversación

A diferencia de la « compresión » clásica, que resume una conversación larga para preservar el contexto, soñar opera a una escala más amplia. El sistema puede examinar múltiples sesiones, varios agentes y varias memorias para destacar tendencias que un único agente podría no notar.

Esto es particularmente útil para flujos de trabajo complejos, donde varios agentes colaboran durante varios minutos u horas en un mismo objetivo.

Anthropic lleva la IA agencial más allá

Este anuncio se inscribe en una ofensiva más amplia alrededor de Claude Managed Agents. Anthropic también está haciendo más accesibles funciones como outcomes, orquestación multi-agente y webhooks, para gestionar mejor agentes que pueden ejecutar tareas con menos intervención humana.

La promesa es clara: pasar de un asistente que responde a un sistema que aprende, coordina y mejora entre sesiones.

Un avance poderoso, pero delicado

La memoria es uno de los grandes desafíos de los agentes de IA. Una memoria demasiado corta hace que el asistente sea incoherente. Una memoria demasiado amplia se vuelve ruidosa, arriesgada y difícil de controlar.

Con soñar, Anthropic intenta encontrar un equilibrio: una memoria más selectiva, útil, pero supervisable. Los desarrolladores podrán elegir entre un proceso automático o una validación manual de los cambios recordados.

A medida que los agentes se vuelven más autónomos, su capacidad para olvidar inteligentemente contará casi tanto como su capacidad para aprender.