OpenAI Daybreak: la IA de GPT-5.5 quiere revolucionar la ciberseguridad defensiva

OpenAI acelera su estrategia en torno a la ciberseguridad con Daybreak, una nueva iniciativa que se presenta como una «IA de frontera para los defensores cibernéticos». Detrás de este nombre evocador—»las primeras luces del amanecer»—la empresa busca reubicar la inteligencia artificial en el corazón del desarrollo de software seguro.

La ambición va mucho más allá de la simple detección de vulnerabilidades. Con Daybreak, OpenAI esboza una visión en la que el software se diseñaría para mantenerse resiliente incluso cuando todavía existe una falla.

Esta estrategia podría transformar profundamente las prácticas de DevSecOps y la manera en que las empresas gestionan su superficie de ataque.

OpenAI Daybreak: un enfoque que supera el modelo clásico de parches

Durante años, la ciberseguridad del software ha funcionado según un ciclo bien conocido: descubrimiento de fallas, corrección, despliegue y luego monitoreo. Un modelo que se ha vuelto difícil de mantener ante la creciente complejidad de las infraestructuras modernas, las cadenas de dependencias de código abierto y las arquitecturas nativas de la nube.

Con Daybreak, OpenAI quiere desplazar el centro de gravedad de la defensa hacia una lógica de resiliencia continua. La idea ya no es solo «corregir rápidamente», sino construir sistemas capaces de absorber o limitar el impacto de las vulnerabilidades antes de que se vuelvan críticas.

La IA juega aquí un papel central. OpenAI explica que sus modelos pueden ahora:

- analizar vastas bases de código,

- identificar vulnerabilidades sutiles,

- comprender sistemas desconocidos,

- proponer soluciones,

- validar las remediaciones,

- acelerar los flujos de trabajo de respuesta.

Esta visión acercaría claramente a Daybreak a un copiloto cibernético orientado a la defensa operativa, en lugar de ser simplemente un escáner de seguridad automatizado.

Codex y la IA agente en el corazón del dispositivo

Técnicamente, Daybreak se basa en varias piezas ya conocidas del ecosistema OpenAI: los modelos GPT-5.5, la escalabilidad de Codex como «agente con capacidad de respuesta», y una red de socios de seguridad integrados en lo que la empresa llama su «flywheel de seguridad».

Concretamente, la plataforma cubre un amplio espectro defensivo: revisión de código seguro, modelado de amenazas, validación de parches, análisis de dependencias, detección de vulnerabilidades, análisis de malware, ingeniería de detección y automatización de la supervisión y la respuesta.

Uno de los puntos más estratégicos sigue siendo la integración directa en los entornos de desarrollo. OpenAI busca claramente mover la ciberseguridad «más temprano» en el ciclo del software, en una lógica similar a la shift-left security ya popularizada en los pipelines modernos de DevOps.

El objetivo: reducir drásticamente el tiempo entre el descubrimiento y la remediación.

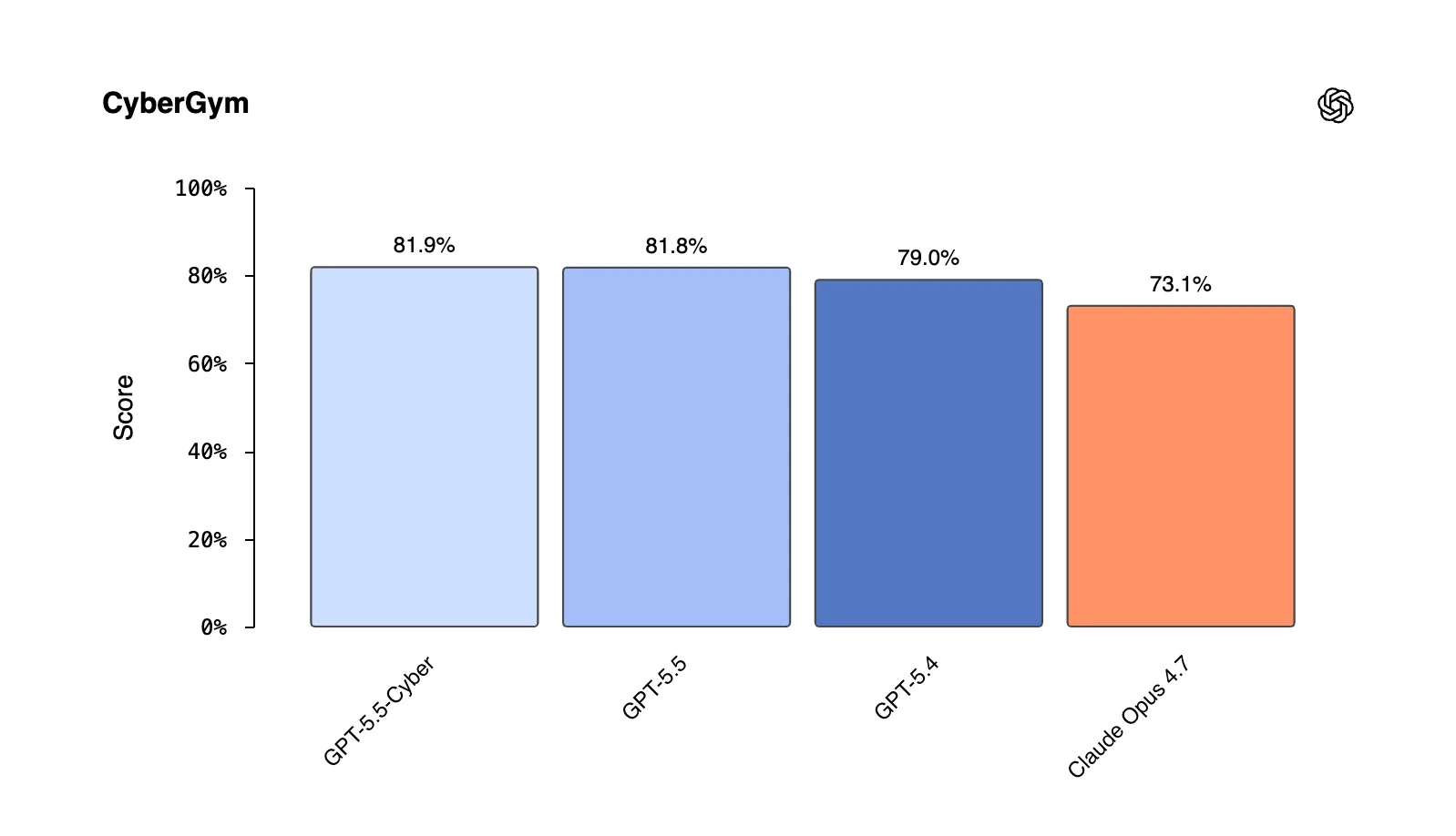

GPT-5.5-Cyber: OpenAI segmenta el acceso a las capacidades ofensivas y defensivas

El aspecto más delicado del anuncio se refiere a los nuevos niveles de acceso a GPT-5.5 dedicados a los flujos de trabajo cibernéticos.

OpenAI introduce tres niveles distintos:

GPT-5.5 estándar

El modelo generalista conserva sus salvaguardias clásicas y se enfoca principalmente en usos para desarrolladores, laborales y analíticos.

GPT-5.5 con acceso confiable para ciber

Esta versión añade mecanismos de verificación más estrictos para las organizaciones que operan en entornos autorizados. Se dirige especialmente al análisis de malware, la validación de parches, la revisión de código seguro, la detección de intrusiones y la priorización de vulnerabilidades.

GPT-5.5-Cyber

Este es el nivel más permisivo. OpenAI lo reserva para flujos de trabajo especializados autorizados, como el red teaming, pruebas de penetración, validaciones controladas y ejercicios de seguridad avanzados.

La empresa enfatiza la presencia de sistemas de verificación reforzados y controles a nivel de cuentas para limitar los usos indebidos.

Esta segmentación revela cuán comprometido está OpenAI a equilibrar dos realidades contradictorias: proporcionar herramientas lo suficientemente potentes para los defensores sin abrir la puerta a capacidades ofensivas descontroladas.

Una respuesta al aumento de las ciberamenazas impulsadas por IA

El anuncio de Daybreak se produce en un contexto particular. Los actores de la ciberseguridad ya están observando un aumento de ataques asistidos por IA: phishing generativo, automatización de reconocimiento, generación de malware polimórfico o explotación acelerada de vulnerabilidades.

Frente a esta evolución, OpenAI parece querer establecer un nuevo paradigma: utilizar la IA no solo como un acelerador de productividad, sino como una capa defensiva nativa del software.

El discurso en torno a la «resiliencia por diseño» es revelador. OpenAI ya no vende simplemente un modelo conversacional, sino una infraestructura de asistencia defensiva continua capaz de integrarse en los flujos de trabajo de desarrollo modernos.

Esta estrategia también acerca a la empresa a competidores como Microsoft, Google o CrowdStrike, que están invirtiendo fuertemente en IA aplicada a la ciberseguridad.

Una ofensiva estratégica mucho más grande que un simple producto de seguridad

Más allá de las funcionalidades técnicas, Daybreak revela sobre todo la evolución del posicionamiento de OpenAI. La empresa ya no se limita a ofrecer modelos de IA generalistas. Está construyendo gradualmente verticales especializadas—ciberseguridad, desarrollo de software, automatización empresarial—capaces de transformar sectores enteros.

Y en la ciberseguridad, el momento es especialmente estratégico: la explosión de vulnerabilidades de software, la escasez mundial de expertos en ciber y la creciente presión regulatoria están empujando a las empresas a automatizar aún más sus defensas.

Con Daybreak, OpenAI parece querer convertirse en un actor estructural de esta nueva generación de seguridad aumentada por IA.

La promesa es ambiciosa: pasar de una ciberseguridad reactiva a una ciberseguridad predictiva e integrada desde el diseño del software. Ahora queda por ver hasta dónde las organizaciones estarán dispuestas a confiar sus flujos de trabajo de seguridad críticos a modelos de inteligencia artificial cada vez más autónomos.