ChatGPT lanza Trusted Contact para alertar a un ser querido en caso de riesgo

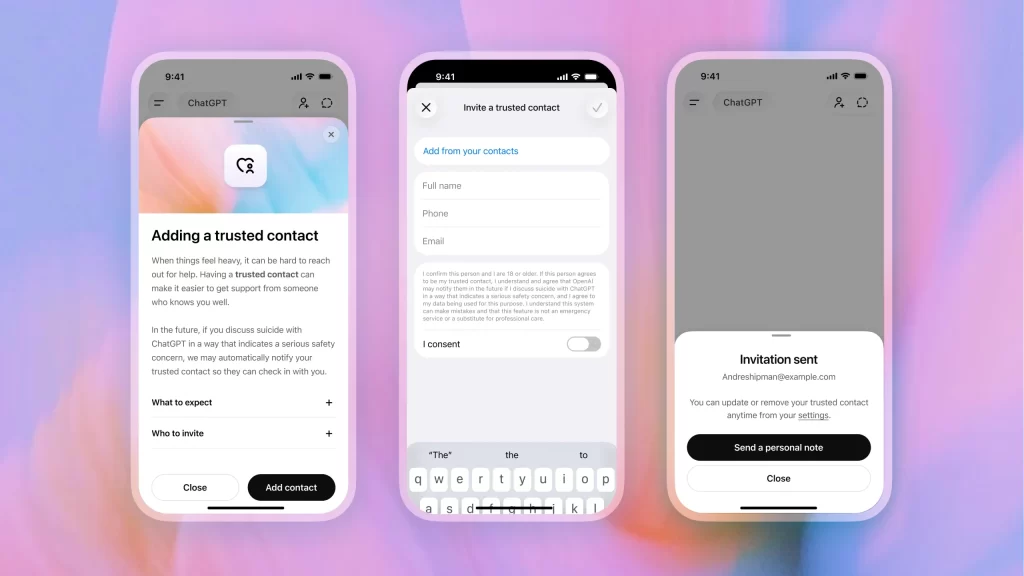

OpenAI presenta una nueva función de seguridad en ChatGPT: «Trusted Contact». Esta herramienta permite a un usuario adulto designar a una persona de confianza que puede ser alertada si una conversación sugiere un riesgo serio de autolesionarse o suicidarse.

Un contacto de confianza, pero no una alerta automática

La opción es opcional. El usuario elige a un adulto, quien recibe una invitación y tiene una semana para aceptar. Si ChatGPT detecta una señal preocupante, se alienta primero al usuario a contactar a esa persona.

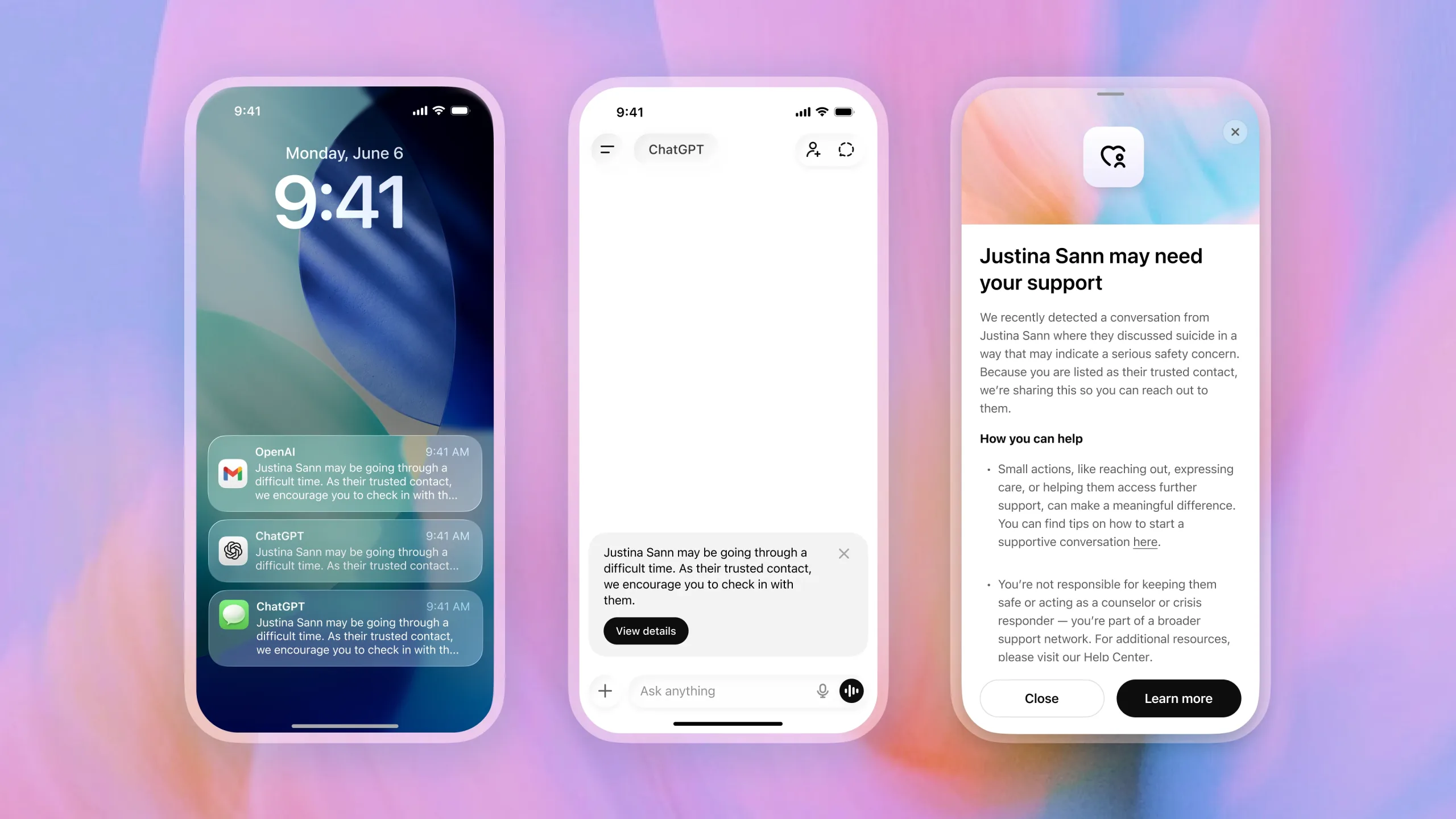

Luego, un equipo humano entrenado revisará el caso antes de realizar cualquier notificación.

La alerta enviada no comparte conversaciones ni detalles privados. Solo indica que se ha planteado un tema relacionado con la autolesión de una manera preocupante, para incitar al ser querido a ponerse en contacto.

Una respuesta a un uso cada vez más íntimo

Esta función amplía las herramientas ya disponibles para cuentas de adolescentes vinculadas a un padre o tutor. Además, llega en un contexto delicado, donde OpenAI enfrenta un aumento de la atención sobre las conversaciones de crisis y cómo los chatbots responden a usuarios vulnerables.

Un guardia, no una solución médica

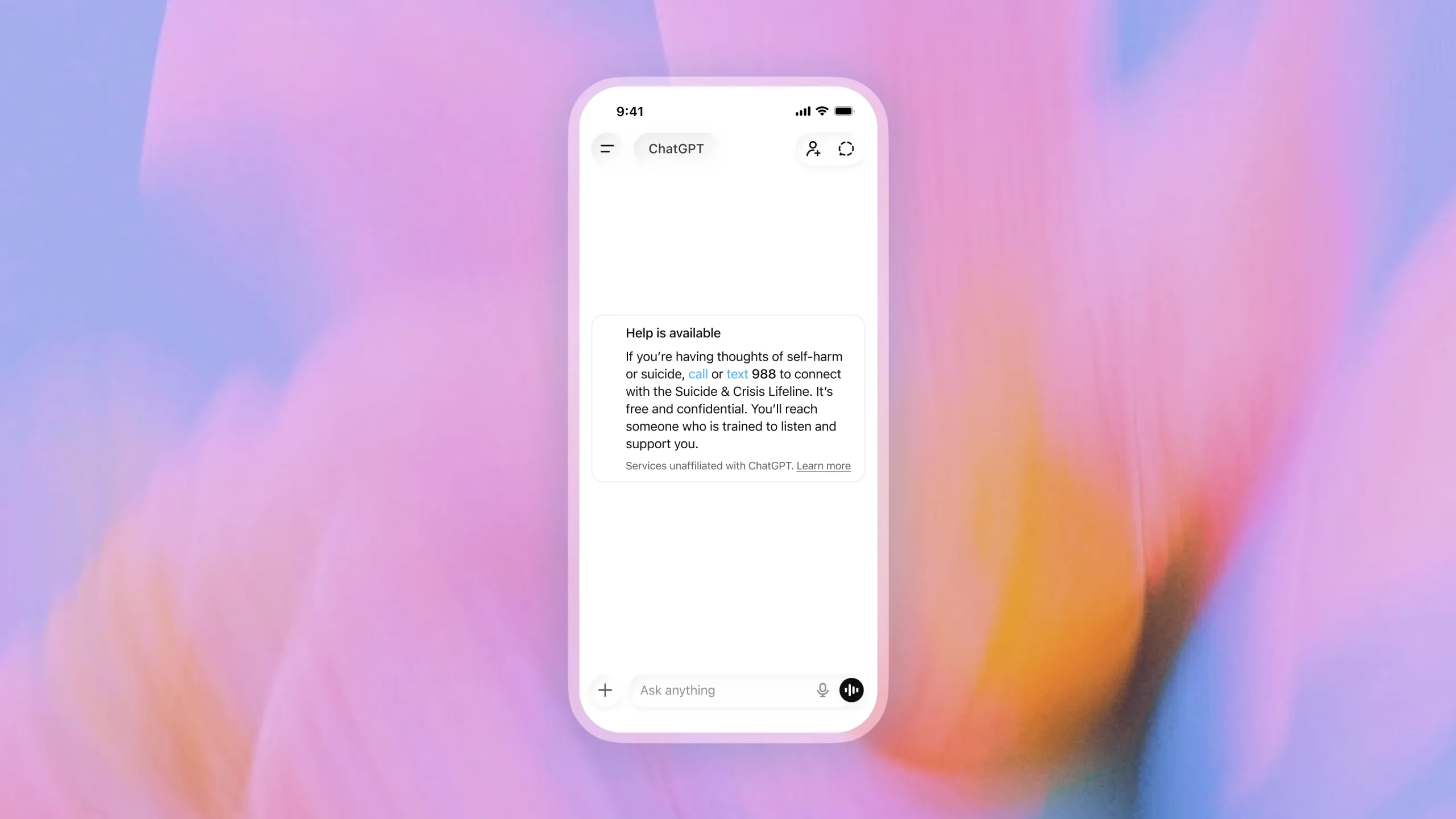

Trusted Contact no reemplaza las líneas de emergencia, ni los servicios de rescate, ni el seguimiento profesional. Sin embargo, reconoce una realidad: ChatGPT se usa a veces como un espacio de confianza, incluso sobre temas delicados.

Con esta función, OpenAI admite implícitamente que un chatbot no puede asumir todo por sí solo. En momentos críticos, la mejor respuesta a menudo implica involucrar a un ser humano.