ChatGPT Health y Claude: por qué las IA de salud pueden contradecirse con sus datos de Apple Watch?

Entregar diez años de datos de Apple Watch a una IA para obtener un veredicto de salud puede parecer una demostración futurista. Sin embargo, en la vida real, esto puede producir algo muy humano… ansiedad. Y, además, un resultado cambiante, a veces a solo unos mensajes de diferencia.

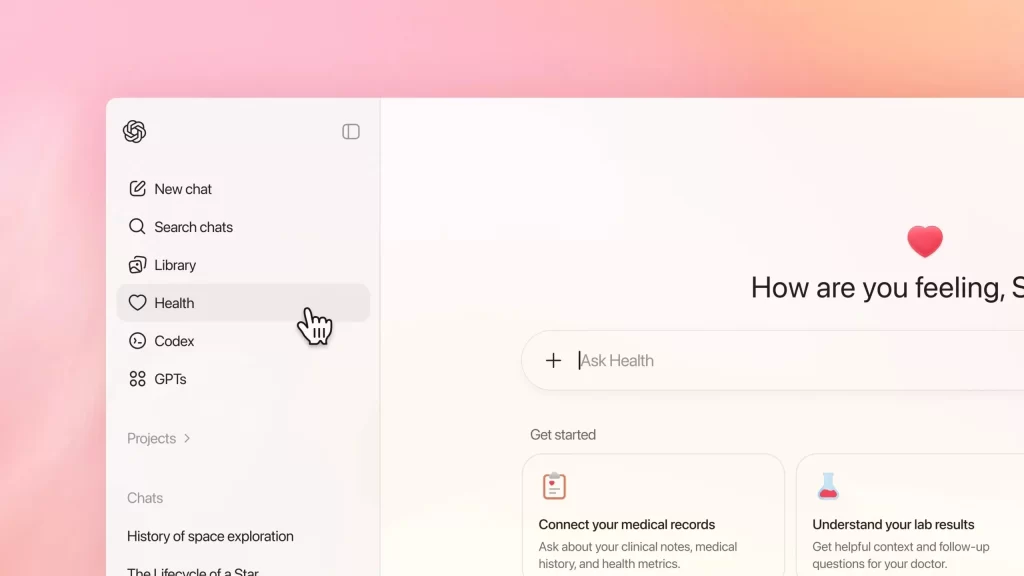

En una investigación reciente, un periodista del Washington Post conectó ChatGPT Health a una década de métricas de la Apple Watch (pasos, frecuencia cardíaca, tendencias, etc.) y pidió una simple calificación de salud cardiovascular. El resultado: un «F». Tras agregar más información médica, la calificación subió… a una «D». Por su parte, Claude for Healthcare de Anthropic otorgó un «C» basándose en datos similares.

El problema es que los médicos consultados posteriormente consideran que estas conclusiones carecen de fundamento y juzgan que el estado general del paciente es bueno.

El núcleo del asunto no es que la IA cometa errores (eso ya lo sabíamos). Se trata de la volatilidad del veredicto, como si la herramienta cambiara de personalidad según el contexto, la formulación o los datos adjuntos. Una «calificación» puede parecer trivial… hasta el momento en que se queda grabada en su mente.

¿Por qué estas «IA médicas» aún están dando vueltas?

Estas nuevas herramientas de salud están diseñadas para transformar números en frases comprensibles: resumir tendencias, explicar resultados, preparar preguntas para hacer a su médico. Anthropic destaca integraciones en beta (Apple Health, Health Connect, HealthEx, Function) y subraya la importancia del consentimiento y la no utilización de datos de salud para el entrenamiento.

No obstante, la investigación del Washington Post revela un clásico error: la ilusión de precisión. El tono suena seguro, el vocabulario médico es creíble… y, sin embargo, la herramienta puede sobrestimar indicadores discutibles, confundir correlación y causalidad o interpretar un signo con ruido como una alarma.

A esto se suma un punto estructural: estas IA no son dispositivos médicos en sentido estricto, y sus salvaguardias son a menudo… disclaimers. En el artículo, expertos también abordan la cuestión de la protección de datos (todas las garantías no siempre se enmarcan en los mismos parámetros que un tratamiento médico).

Tras la funcionalidad, una batalla estratégica (incluido Apple)

Lo que está en juego aquí va más allá de un simple gadget. OpenAI y Anthropic buscan convertirse en la interfaz «natural» de su vida digital — y la salud es el Santo Grial: datos frecuentes, personales y ricos en contexto.

Y, Apple está observando, desde luego. Según rumores persistentes, Cupertino estaría preparando Health+, una oferta de coaching (posiblemente impulsada por IA) para 2026. Si estos planes se materializan, Apple deberá triunfar donde otros ya han tropezado: en fiabilidad, explicabilidad y, sobre todo, en un tono que ayude sin desencadenar alertas injustificadas.

El uso «seguro» se dibuja bastante claro:

- Sí a resumir, traducir un jargon, preparar citas.

- No a dejarse atrapar en una calificación o diagnóstico proveniente de un chat.

El mayor riesgo no es solo el error: es la autoridad percibida. Un «F» puede llevar a la desesperación, un «A» puede hacer que se ignore una señal real. En ambos casos, la máquina se convierte en un árbitro emocional — y eso es precisamente lo que no debería ser.