ChatGPT te escucha: Estos 5 documentos que nunca debes subir

Los chatbots de IA han normalizado un acto que hace apenas un tiempo parecía riesgoso: enviar un documento, pegar un bloque de texto, subir una foto y luego pedir un resumen, una corrección o una transformación visual. En cuestión de segundos, un contrato se convierte en un resumen, un PDF médico se transforma en una explicación sencilla, y un selfie puede transformarse en una ilustración al estilo anime. Precisamente aquí es donde la comodidad empieza a rozar el peligro.

Porque detrás de esta facilidad, una realidad persiste: lo que compartes con un asistente como ChatGPT no desaparece simplemente después de la respuesta.

Una parte de estos datos se procesa en servidores remotos, a veces se conserva, a veces se utiliza para mejorar los modelos según los ajustes elegidos y, en ocasiones, está sujeta a obligaciones legales de conservación. En OpenAI, la política oficial aclara que el contenido transmitido puede incluir archivos, imágenes, audio, video y datos de servicios conectados.

Para los servicios de consumo como ChatGPT, Codex o Sora, la empresa indica que puede utilizar este contenido para mejorar sus modelos, a menos que el usuario se retire explícitamente de este uso.

Lo que realmente sucede cuando envías algo a ChatGPT

El primer reflejo a corregir es una idea muy extendida: pensar que un prompt o archivo sirve únicamente para producir una respuesta y luego desaparece. OpenAI explica, en cambio, que las conversaciones y archivos se procesan en sus sistemas, y que las conversaciones efímeras solo se eliminan después de 30 días, a menos que haya una necesidad de seguridad o una obligación legal. Su ayuda oficial también aclara que las conversaciones efímeras no se utilizan para el entrenamiento, no aparecen en el historial y solo se pueden revisar para detectar abusos.

Dicho de otro modo, incluso cuando un servicio ofrece opciones de privacidad, la buena práctica no es suponer una desaparición inmediata de los datos. El verdadero marco es más matizado: el uso del contenido según los ajustes, la eliminación diferida y posibles excepciones legales. Esta distinción es esencial si se manejan documentos sensibles.

El verdadero riesgo: compartimos a menudo demasiado sin darnos cuenta

El problema no es solo lo que la IA «ve». También es lo que le damos sin pensarlo. Al pegar un correo electrónico, un informe, una receta médica, una factura o una captura de pantalla en un chatbot, a menudo se transmite más de lo que se quería analizar. Un documento puede contener un nombre completo, una dirección, un número de contrato, un IBAN, un identificador, un historial médico o incluso metadatos invisibles a simple vista.

OpenAI deja claro, de hecho, que los contenidos transmitidos en sus servicios de consumo pueden incluir archivos e imágenes, y que, dependiendo de la configuración del usuario, estos contenidos pueden ser utilizados para mejorar los modelos. Esto significa que un PDF médico o un contrato anotado nunca debe considerarse neutral simplemente porque se envía para «obtener un consejo» o «hacer un resumen».

Las fotos plantean un problema similar. Más allá de la imagen en sí, pueden incluir metadatos EXIF que contienen la hora, el modelo de la cámara y, a veces, la geolocalización. Por lo tanto, si subes una foto a un servicio en la nube de IA, no solo se analiza tu rostro: también se evalúa todo el entorno informático vinculado al archivo, a menos que lo hayas limpiado previamente.

Lo que realmente no debes enviar

La regla más sólida sigue siendo la más simple: nunca subas lo que no estarías dispuesto a ver alojado en un sistema de terceros. En la práctica, esto incluye contraseñas, identificadores de conexión, claves API, información bancaria, documentos médicos nominales, identificaciones, contratos no anonimizados, recibos de sueldo, capturas de pantalla de interfaces internas y fotos cuyas metadatos no han sido eliminados.

Aún cuando un chatbot sea extremadamente útil para analizar un problema, es preferible reformular manualmente el contexto en lugar de enviar una captura bruta con demasiada información. Y cuando un documento realmente necesite ser procesado, lo ideal es eliminar previamente nombres, números, datos de contacto, montos sensibles, firmas y referencias únicas.

¿Cómo usar ChatGPT con más cautela?

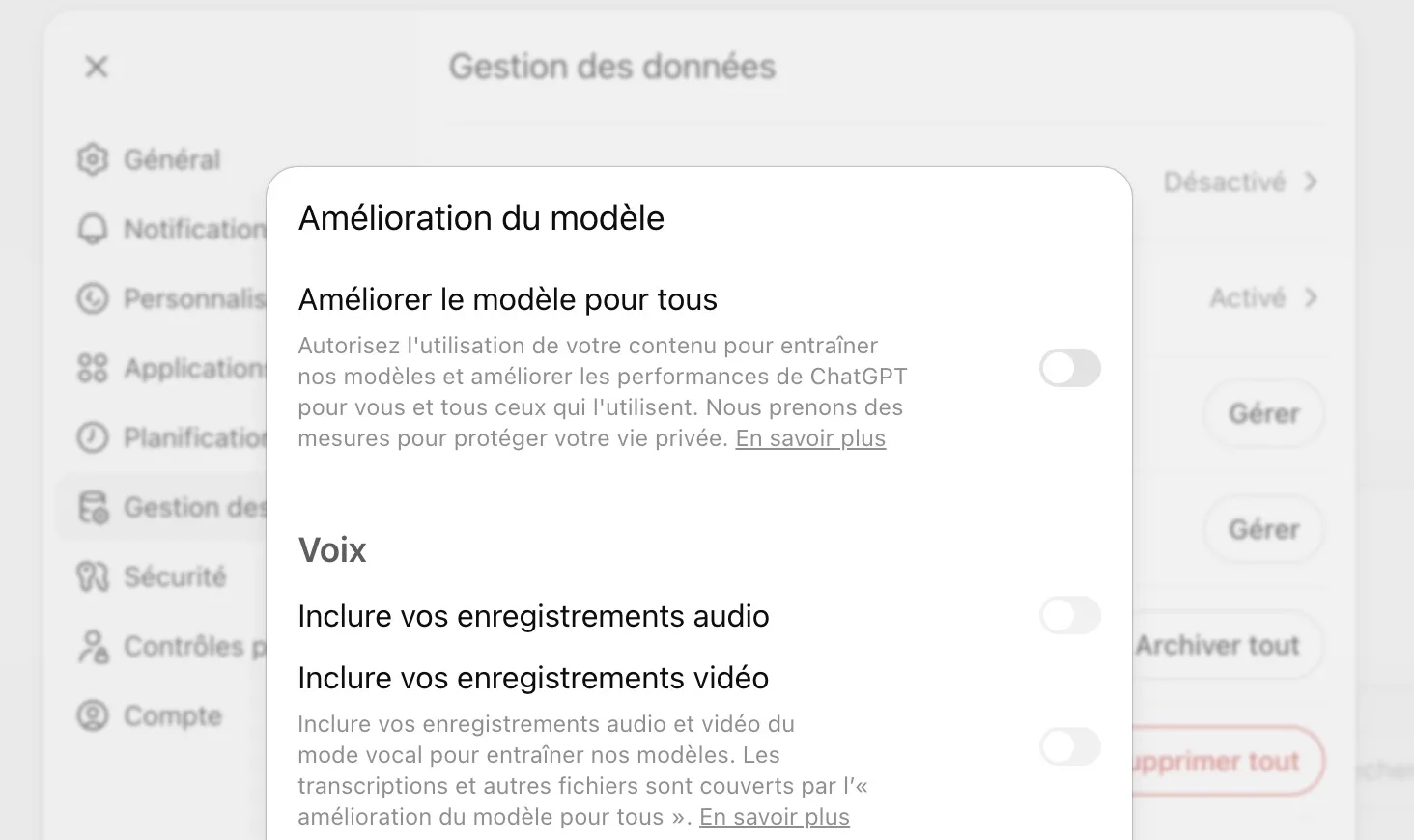

Afortunadamente, OpenAI permite reducir parte de la exposición. En la configuración de gestión de datos, es posible desactivar «Mejorar el modelo para todos». OpenAI aclara que una vez desactivada esta opción, las nuevas conversaciones ya no se utilizarán para entrenar sus modelos. Las conversaciones efímeras añaden una capa adicional: no se utilizan para el entrenamiento y se eliminan en un plazo de 30 días.

No obstante, es importante ser realistas: esto no convierte automáticamente a ChatGPT en un cofre de seguridad. Estos ajustes reducen el uso de datos para la mejora de modelos, pero no alteran la realidad del procesamiento en el servidor ni los casos en los que puede aplicarse la conservación temporal o legal. Por lo tanto, el mejor principio sigue siendo la minimización: enviar solo lo estrictamente necesario, nunca el original completo si una versión expurgada es suficiente.

La alternativa más discreta: modelos locales

Para aquellos que manejan frecuentemente contenidos sensibles, la verdadera alternativa no es necesariamente un mejor ajuste en la nube, sino un LLM local. El principio es sencillo: el modelo se ejecuta en tu máquina, y el documento no tiene que abandonar tu computadora para ser resumido o analizado.

LM Studio, por ejemplo, establece en su política de privacidad que los mensajes, historiales y documentos no se transmiten desde tu sistema de forma predeterminada y permanecen guardados localmente en el dispositivo. Esto no hace que su uso sea «mágicamente seguro» —un dispositivo comprometido sigue siendo un dispositivo comprometido—, pero al menos elimina la capa de transmisión a un proveedor externo para la inferencia misma.

Hoy en día, esta es la opción más racional para resumir documentos confidenciales, revisar notas sensibles o experimentar con archivos que no se desea que salgan de su entorno personal o profesional. La nube sigue teniendo una ventaja clara en velocidad, calidad y comodidad.

Pero si la privacidad se convierte en una prioridad real, lo local deja de ser una mera curiosidad para convertirse en una opción seria.

El buen reflejo en 2026: tratar a un chatbot como un servicio externo, no como un cuaderno privado

El verdadero error podría ser confundir la intimidad conversacional con la confidencialidad técnica. Un chatbot responde en un tono personal, recuerda el contexto, parece cercano, casi privado. Pero desde el punto de vista del tratamiento de datos, sigue siendo un servicio informático con sus políticas, registros, excepciones y limitaciones legales.

Por eso, la mejor práctica es resumir en una frase: nunca envíes a una IA en la nube lo que no le confías con plena conciencia. Los modelos se han vuelto lo suficientemente buenos como para hacernos olvidar la infraestructura que los sostiene. El verdadero desafío, hoy en día, es precisamente no olvidarla.