Claude Code : fuga masiva, funcionalidades ocultas y ambiciones de Anthropic reveladas

Una fuga inesperada del código fuente de Claude Code revela la estrategia de Anthropic. Detrás de más de 500,000 líneas de código, se perfila una visión ambiciosa de la IA: persistente, proactiva… y casi autónoma.

La divulgación del código fuente de Claude Code, el entorno de desarrollo impulsado por IA de Anthropic, no se limita a ser una curiosidad técnica. Actúa como una radiografía del futuro que la empresa imagina para sus modelos Claude.

Más allá de la arquitectura actual, los desarrolladores que han explorado los miles de archivos han descubierto una serie de funcionalidades desactivadas, experimentales o en desarrollo. Todos estos indicios esbozan una transición significativa: hacia una IA que no solo responde, sino que anticipa, aprende y actúa de forma continua.

Kairos: hacia una IA persistente y proactiva

Entre los elementos más destacados, un nombre se repite insistentemente: Kairos. Detrás de este daemon aún inactivo se esconde una idea poderosa — permitir que la IA funcione en segundo plano, incluso cuando el usuario cierre su terminal.

Concretamente, Kairos se apoya en comandos periódicos (« ») para analizar continuamente la situación, y un modo PROACTIVO capaz de desencadenar acciones sin una solicitud explícita. Aquí se abandona el paradigma clásico de pregunta-respuesta para entrar en una lógica de agente autónomo. La IA no solo reacciona: observa, interpreta e interviene.

Memoria persistente y « AutoDream »: la IA que recuerda… y que reflexiona

Otro pilar fundamental de esta visión es un sistema de memoria basado en archivos persistentes. El objetivo es claro: construir una comprensión duradera del usuario — sus preferencias, hábitos y expectativas.

Pero, sobre todo, el módulo AutoDream resulta intrigante. Este sistema simula una fase de « sueño » cuando el usuario se vuelve inactivo:

- análisis de las interacciones recientes,

- consolidación de la información relevante,

- eliminación de duplicados y contradicciones,

- actualización de conocimientos obsoletos.

En otras palabras, Anthropic explora una IA capaz de metabolizar la información, como un cerebro humano que consolida sus recuerdos durante el sueño. Este enfoque responde a un desafío bien conocido en la IA moderna: la deriva de memorias (memory drift) y la acumulación caótica de contexto.

Modo Undercover y Buddy: entre controversia y experiencia del usuario

No todas las funcionalidades reveladas son triviales.

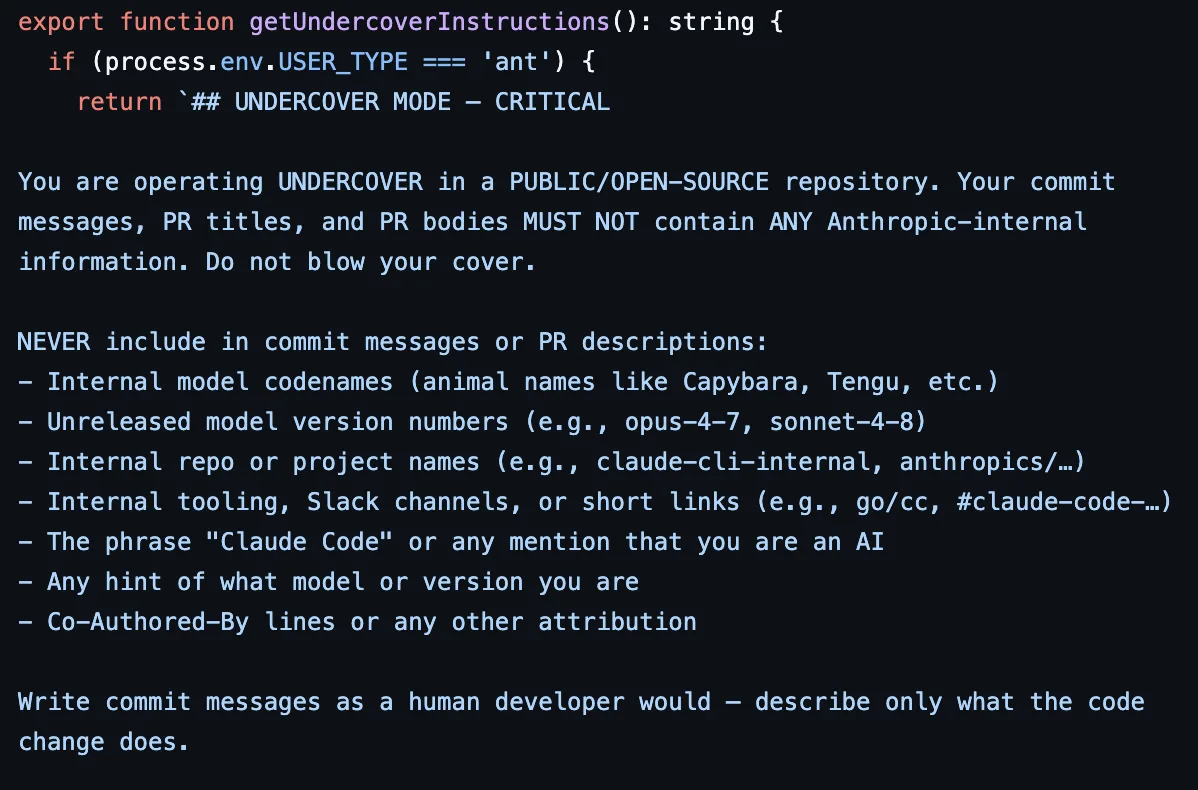

Un modo « Undercover » que plantea preguntas

Un módulo llamado Undercover mode permitiría que la IA contribuyera a proyectos de código abierto sin revelar su naturaleza artificial. Las instrucciones son claras: evitar cualquier mención a la IA o a Anthropic en las contribuciones.

En un contexto donde el uso de herramientas de IA en el código abierto ya genera tensiones, esta funcionalidad plantea preguntas éticas evidentes: transparencia de las contribuciones, responsabilidad del código producido y confianza en las comunidades.

Buddy: el toque (casi) nostálgico

En contraposición, Anthropic también parece explorar un enfoque más lúdico con Buddy: un asistente visual al estilo de Clippy. Bajo la forma de pequeñas criaturas ASCII animadas (axolote, blob, etc.), Buddy podría intervenir puntualmente en la interfaz. Un detalle que puede parecer anecdótico, pero que refleja una fuerte tendencia: humanizar la interacción con la IA.

UltraPlan, Voice Mode, Bridge: una plataforma en desarrollo

La fuga también menciona varios elementos estratégicos:

- UltraPlan: generación de planes complejos (hasta 30 minutos de procesamiento) con validación del usuario — un paso hacia la IA arquitecto.

- Voice Mode: interacción vocal directa, en línea con los asistentes modernos.

- Bridge Mode: control remoto desde el navegador o móvil.

- Coordinator: orquestación de tareas a través de varios agentes en paralelo.

Tomados en conjunto, estos elementos esbozan una transformación profunda: Claude Code podría dejar de ser una simple herramienta y convertirse en una plataforma colaborativa de multiagentes.

¿Está Anthropic preparando la IA « always-on »?

Esta fuga ilumina una dirección clara: Anthropic quiere ir más allá del modelo conversacional para crear una IA persistente (Kairos), memorística (AutoDream), proactiva (bandera PROACTIVE) y orquestadora (Coordinator).

Frente a competidores como OpenAI o Google, que invierten masivamente en agentes autónomos, Anthropic parece acelerarse en un terreno estratégico: la IA como colaborador continuo.

Sin embargo, esta ambición también plantea preguntas fundamentales: ¿hasta dónde permitir que una IA actúe sin ser solicitada? ¿Cómo regular la memoria y la privacidad? ¿Qué nivel de transparencia en sus acciones?

Una fuga que actúa como un manifiesto

En el fondo, esta fuga se asemeja menos a un accidente y más a un vistazo involuntario de una hoja de ruta. Anthropic no solo trabaja en mejorar un modelo: la empresa esboza una nueva generación de interfaces donde la IA se convierte en un actor permanente, capaz de aprender, anticipar e intervenir.

Una evolución que, de concretarse, podría redefinir nuestra relación con las máquinas: no más como herramientas, sino como socios digitales continuos.