Gemini 3 Flash: Agentic Vision transforma el análisis de imágenes en investigación con ejecución de código

Hasta ahora, la mayoría de los modelos «de visión» miraban una imagen como se podría observar un cartel: de una sola vez, luego improvisaban si se les pasaba algún detalle. Google DeepMind ha anunciado un cambio en su método con Agentic Vision en Gemini 3 Flash: la imagen ya no solo se interpreta, sino que se explora activamente, paso a paso, ejecutando código Python para hacer zoom, recortar, anotar y verificar antes de responder.

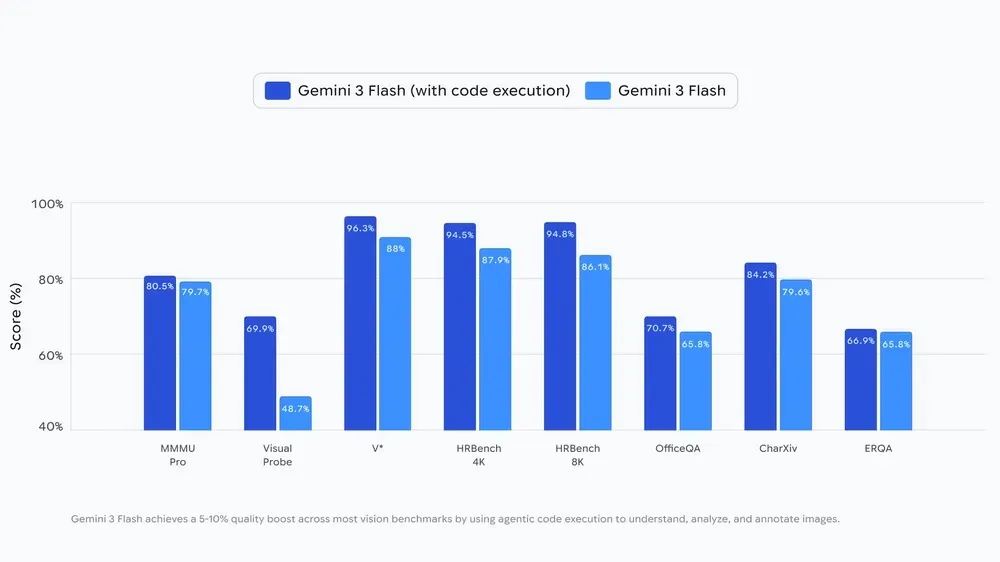

Google afirma que habilitar la ejecución de código con Gemini 3 Flash aporta una mejora constante en la calidad de entre el 5 y el 10% en la mayoría de los benchmarks de visión.

Lo que cambia Agentic Vision: de «veo» a «verifico»

Google DeepMind resume el problema de los modelos multimodales clásicos: si se pierden un detalle fino —un número de serie en un microcomponente, un cartel a lo lejos—, se ven obligados a adivinar. Agentic Vision invierte la lógica al tratar la visión como un proceso de investigación: el modelo planifica, actúa y luego vuelve a observar con un nuevo contexto visual.

No se trata solo de precisión: es la capacidad de reducir la alucinación visual al reemplazar la estimación probabilística con operaciones controlables.

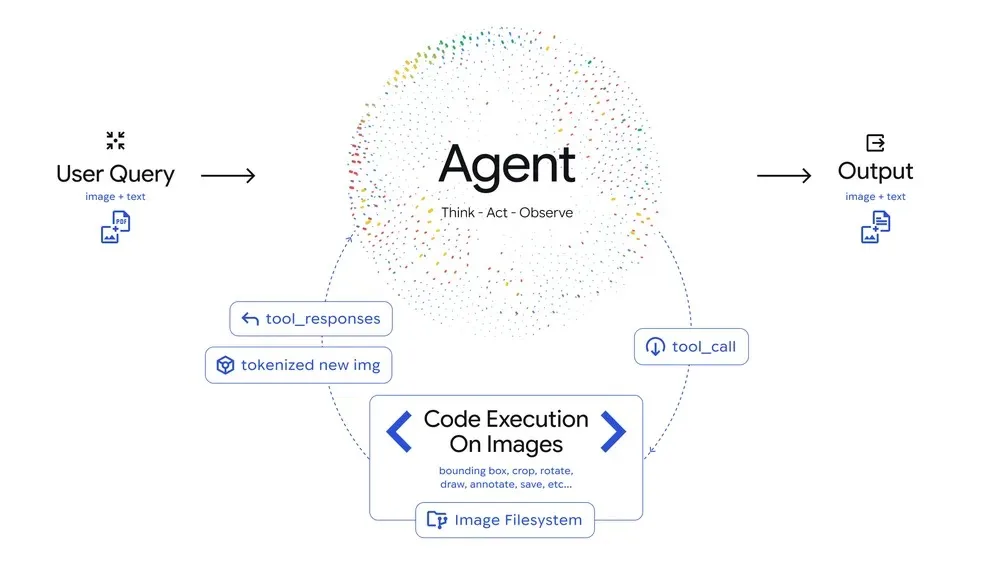

¿Cómo funciona?: pensar → actuar → observar

Google describe un ciclo iterativo en tres etapas:

- Pensar: el modelo analiza la pregunta + la imagen y establece un plan de múltiples pasos.

- Actuar: genera y ejecuta Python para manipular la imagen (recorte, rotación, anotación) o analizarla (conteo, cálculos…).

- Observar: la imagen transformada se reinserta en la ventana de contexto, y el modelo reexamina los nuevos elementos antes de concluir.

Es una evolución importante: la IA no se limita a ser «multimodal», se convierte en una herramienta, y por lo tanto, se asemeja más a un asistente técnico capaz de producir respuestas rastreables.

Casos de uso muy concretos: zoom implícito, anotaciones, «matemáticas visuales»

Google ilustra tres ventajas inmediatas:

- Zoom/inspección fina: Gemini 3 Flash está entrenado para «hacer zoom implícitamente» cuando es necesario. La empresa cita a PlanCheckSolver.com, que supuestamente ganó un 5% de precisión al habilitar la ejecución de código para recortar y analizar áreas de un plano (bordes de techo, secciones de edificios), y luego reintegrarlos en el contexto.

- Anotación: en lugar de «describir», el modelo puede dibujar cuadros y etiquetas sobre la imagen para auto- verificar (ej: contar dedos) — una suerte de borrador visual que reduce los errores de conteo.

- Matemáticas visuales y gráfico: lectura de tablas densas + normalización + gráfico de Matplotlib, con cálculos desplazados a un entorno Python determinista (y por lo tanto verificable).

Se vislumbra una filosofía: cuando la respuesta depende de un detalle, la mejor estrategia no es «razonar más fuerte», sino medir mejor.

API primero, aplicación después

Agentic Vision está disponible ahora a través de la API Gemini en Google AI Studio y Vertex AI. El despliegue también comienza en la aplicación Gemini, accesible al seleccionar la opción «Pensamiento» en la elección de modelos.

Para los desarrolladores, Vertex AI ya documenta la ejecución de código como una capacidad soportada por Gemini 3 Flash (vista previa), junto con el grounding y las instrucciones del sistema.

La verdadera ruptura es la «prueba» en lugar de la prosa

Este lanzamiento cuenta una transformación más amplia: el futuro de los modelos visuales no se medirá únicamente por puntajes, sino por su capacidad de producir respuestas fundamentadas en operaciones reproducibles (recorte, conteo, cálculo). No es un detalle de UX: es un cambio epistemológico. Una IA que puede mostrar cómo ha verificado un área de imagen se aproxima a un asistente «profesional» —útil en inspección, conformidad, industria, salud, seguros, arquitectura.

DeepMind lo expresa sin rodeos: hoy el zoom ya es muy «implícito», pero comportamientos como rotación o matemáticas visuales aún requieren un «empujón» —y Google está trabajando para hacerlos automáticos, explorando además otras herramientas (web, búsqueda de imágenes inversa) y una extensión a otros tamaños de modelos.