Google acelera Gemma 4: la IA local podría volverse hasta tres veces más rápida

Google quiere hacer que la IA local sea verdaderamente utilizable en dispositivos de consumo. Con la llegada de los nuevos « MTP drafters » para Gemma 4, la empresa promete importantes ganancias de velocidad sin sacrificar la calidad de las respuestas.

Gemma 4 gana un modo turbo

Google ha lanzado nuevos módulos experimentales llamados Multi-Token Prediction (MTP) para sus modelos abiertos Gemma 4.

El principio se basa en una técnica llamada decodificación hipotética: en lugar de generar palabras una a una de la manera habitual, un pequeño modelo auxiliar intenta predecir varios tokens a la vez mientras el modelo principal verifica esas predicciones en paralelo.

El resultado: una generación mucho más rápida, especialmente en hardware limitado, como smartphones o GPU de consumo.

¿Por qué la IA local suele ser lenta?

Los modelos de lenguaje de gran tamaño (LLM) normalmente funcionan de forma autorregresiva: cada token depende del anterior. El problema es que este método consume mucha memoria de video y requiere transferencias de datos masivas entre la memoria y el procesador.

En infraestructuras en la nube optimizadas como las de Gemini, esto no es un gran problema. Sin embargo, en un PC o un teléfono, los tiempos de espera aumentan rápidamente.

Los drafters MTP aprovechan precisamente los periodos en que las unidades de cálculo están infrautilizadas para generar secuencias especulativas con antelación.

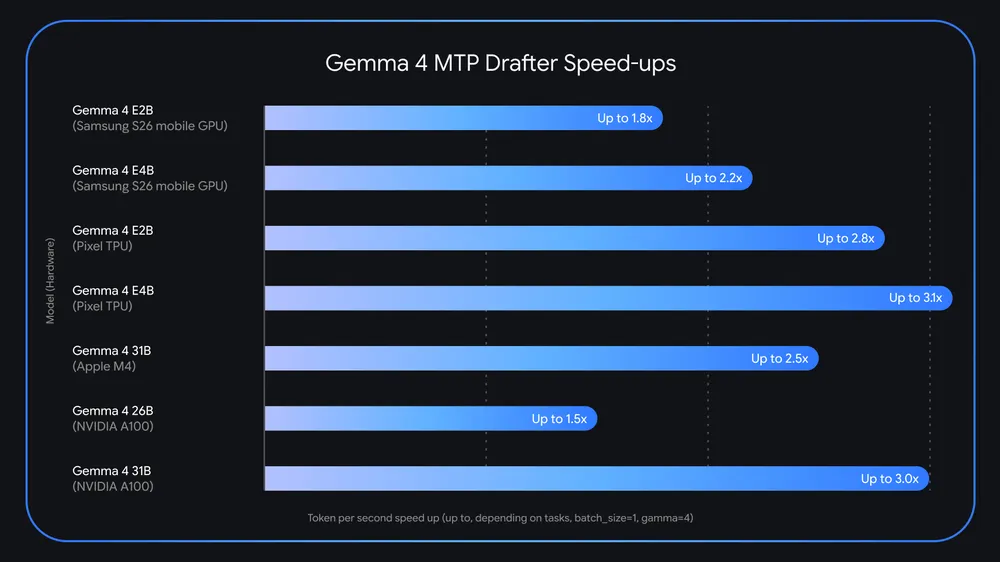

Hasta 3 veces más rápido en móvil

Google afirma que ciertos modelos de Gemma 4 pueden ahora funcionar hasta tres veces más rápido dependiendo del hardware utilizado:

- Gemma E2B: hasta 2,8 veces más rápido en Pixel

- Gemma E4B: hasta 3,1 veces más rápido

- Gemma 31B: aproximadamente 2,5 veces más rápido en chips Apple M4

La empresa también aclara que este enfoque no debería, teóricamente, degradar la calidad, ya que el modelo principal valida los tokens antes de mostrarlos.

Una estrategia importante para la IA fuera de la nube

Esta evolución es muy significativa. La IA local se convierte en un tema clave para la industria: mejor privacidad, reducción de costos en la nube, funcionamiento sin conexión y menor latencia.

Google está claramente promoviendo Gemma como una alternativa abierta y local a sus modelos en la nube de Gemini.

El cambio de licencia hacia Apache 2.0 también va en esta dirección: Google busca atraer desarrolladores, empresas y comunidades de código abierto de manera más agresiva.

La verdadera batalla: hacer que la IA sea personal

El objetivo va más allá de la simple velocidad. Para que la IA sea omnipresente en PC, smartphones u objetos conectados, necesita funcionar de manera eficiente en hardware común.

Con MTP, Google intenta abordar precisamente este problema: ejecutar modelos potentes localmente sin requerir infraestructuras de centro de datos.

Y en esta batalla, la velocidad es casi tan crucial como la inteligencia.