La fascinación por la IA conversacional parece estar disminuyendo. Tras una fase de experimentación y curiosidad casi instintiva alrededor de herramientas como ChatGPT y Gemini, ahora surge una nueva dinámica: un público más cauteloso, más consciente y, sobre todo, más atento a lo que comparte con estas plataformas.

Un nuevo informe de Malwarebytes indica que la desconfianza en el uso de datos personales por parte de la IA ya no es solo un malestar difuso, sino un comportamiento concreto.

Una adopción todavía real, pero una confianza que disminuye notablemente

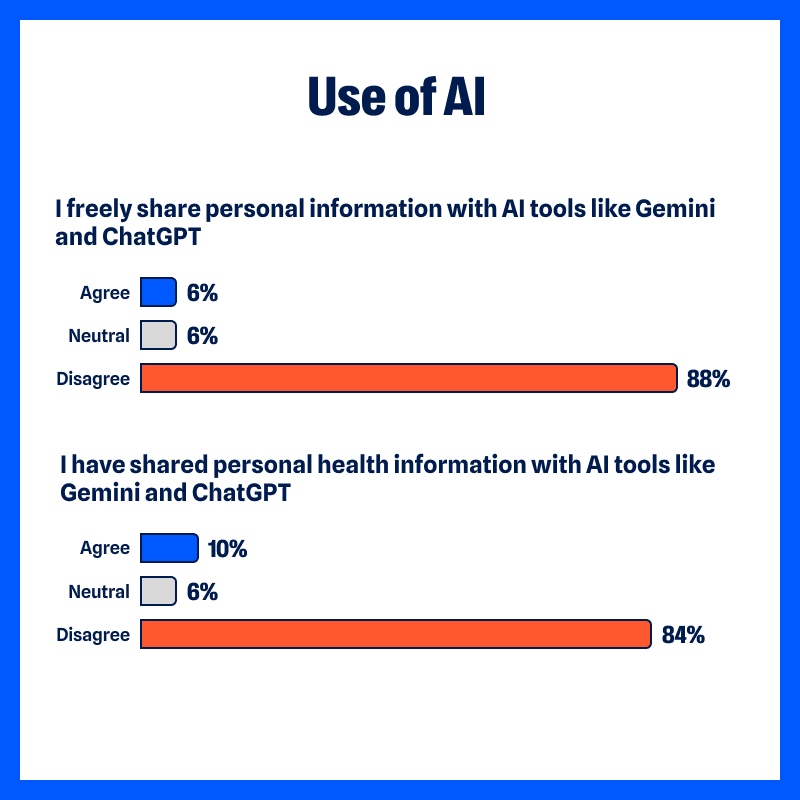

Según la encuesta publicada, el 90 % de los encuestados manifiestan preocupación por la posibilidad de que la IA utilice sus datos sin su consentimiento, mientras que el 88 % aseguran que no comparten libremente su información personal con herramientas como ChatGPT o Gemini.

Más revelador aún, el 84 % declara no haber compartido datos de salud con estos asistentes.

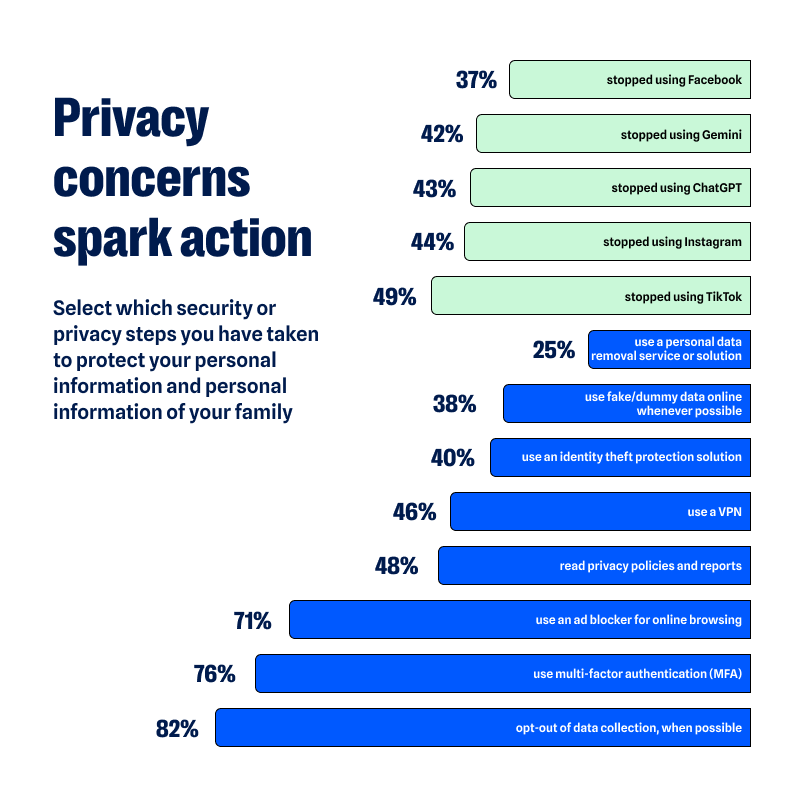

La señal más fuerte puede estar en la evolución de los usos: el 43 % de los encuestados dice haber dejado de usar ChatGPT, y el 42 % afirma haber dejado de usar Gemini. Estos números por sí solos son impactantes, pero cuentan una historia más amplia: la IA ya no se percibe solamente como un atajo práctico o una moda tecnológica.

Para una parte del público, se está convirtiendo en un espacio de riesgo que hay que aprender a evitar, limitar o mantener a distancia.

La privacidad se convierte en un criterio de uso, no solo en un tema de debate

Aquí es donde el estudio se vuelve interesante. Malwarebytes no solo describe una preocupación teórica; también observa una serie de acciones de protección que ya están en marcha. El informe indica que el 82 % de los encuestados busca rechazar la recopilación de datos siempre que sea posible, el 71 % utiliza un bloqueador de anuncios, y el 46 % recurre a una VPN.

Malwarebytes también señala que una parte creciente de los usuarios lee más las políticas de privacidad, a veces proporciona datos falsos o recurre a servicios de eliminación de información personal.

En otras palabras, la relación entre el público y la IA entra en una fase más madura. Ya no se pregunta únicamente qué pueden hacer estas herramientas. Se comienza a cuestionar seriamente qué ven, qué retienen y cómo podrían reutilizar esa información.

Las redes sociales también sufren las consecuencias de esta desconfianza

La encuesta de Malwarebytes relaciona esta desconfianza con comportamientos más amplios dentro del ecosistema digital. El 44 % de los encuestados afirma haber dejado de usar Instagram, y el 37 % Facebook. El informe no presenta estos abandonos como una prueba directa de un rechazo de la IA generativa de Meta, sino que los enmarca dentro de un clima general de fatiga hacia las plataformas que acumulan datos, automatización y personalización opaca.

Es necesario ser cauteloso al interpretar estos datos. El estudio proviene de un editor de soluciones de ciberseguridad, no de un instituto académico independiente, y mide principalmente un sentimiento declarado. Sin embargo, incluso con esta reserva, el movimiento que describe es coherente con una tendencia más amplia: a medida que la IA se integra en los usos cotidianos, la cuestión de la confianza se vuelve casi más importante que la de la rendimiento.

El verdadero desafío para OpenAI, Google y otros

Para los grandes actores de la industria, el mensaje es bastante claro. El problema ya no es solo hacer un chatbot más rápido, preciso o versátil. También es necesario convencer que puede mantenerse en su lugar. La promesa de utilidad ya no es suficiente si conlleva un continuo desfase sobre la recopilación, el uso y la retención de datos personales.

Este podría ser el giro más interesante de 2026: el debate sobre la IA está avanzando gradualmente del ámbito de la demostración al del consentimiento. Y en esta nueva fase, las empresas que tengan éxito no serán necesariamente las que cuenten con los modelos más espectaculares, sino las que sepan construir un marco de uso lo suficientemente claro para restaurar la confianza.

En el fondo, la «fatiga por la IA» puede que no sea un rechazo al propio uso de la herramienta. Puede parecerse más a una nueva exigencia: sí a una inteligencia artificial útil, pero más sobria, más transparente y mucho menos intrusiva.