Hay actualizaciones que mejoran ligeramente. Y luego están las que transforman el producto de manera fundamental. Con LM Studio 0.4.0, esta herramienta preferida entre los entusiastas de los modelos locales no solo es una bonita interfaz para interactuar con un LLM en su GPU, sino que se convierte en una infraestructura diseñada para servir solicitudes en paralelo, integrarse en flujos de trabajo e incluso funcionar «headless» en un servidor.

Un giro claro: de la aplicación de escritorio a la plataforma de despliegue

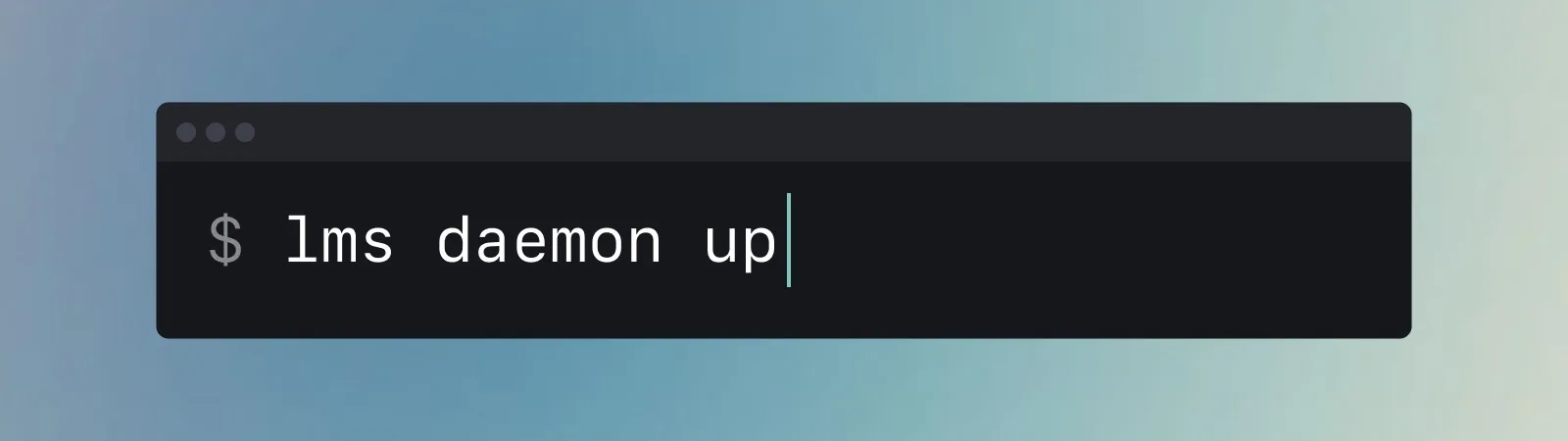

La novedad más estructurante se llama llmster: el «corazón» de LM Studio, ahora empaquetado para funcionar sin interfaz gráfica, en modo daemon, y desplegarse en una máquina Linux, una instancia en la nube… incluso en un Colab. El equipo explica que ha separado la interfaz del motor para hacer posible este escenario.

En términos concretos: LM Studio ya no está dirigido únicamente al usuario que quiere ejecutar un modelo de manera local «como ChatGPT», sino también al desarrollador —o equipo— que desea alojar su propio endpoint y conectar aplicaciones a él.

Rendimiento pensado para servidores: solicitudes paralelas y procesamiento continuo

LM Studio 0.4.0 introduce la gestión de solicitudes concurrentes a un mismo modelo mediante el batching continuo, un enfoque que busca maximizar el rendimiento y la eficiencia cuando llegan múltiples solicitudes al mismo tiempo.

Punto técnico importante: LM Studio indica que su motor llama.cpp «actualiza» a la versión 2.0.0, lo que acompaña la llegada de esta competencia en términos de inferencia (con ajustes como el número máximo de predicciones simultáneas y una gestión unificada de la caché KV).

Una API más «pro»: chat con estado, control de acceso y endpoints nativos

Otro componente: una API REST nativa v1 (en /api/v1/*) y un endpoint de chat con estado que permite continuar una conversación utilizando identificadores (response_id, previous_response_id) —práctico para flujos de trabajo de múltiples etapas sin tener que reenviar todo el contexto en cada llamada.

LM Studio también añade una lógica de claves de permiso (control de clientes autorizados) y pone de relieve el apoyo a usos habilitados (notablemente a través de MCP, según la documentación).

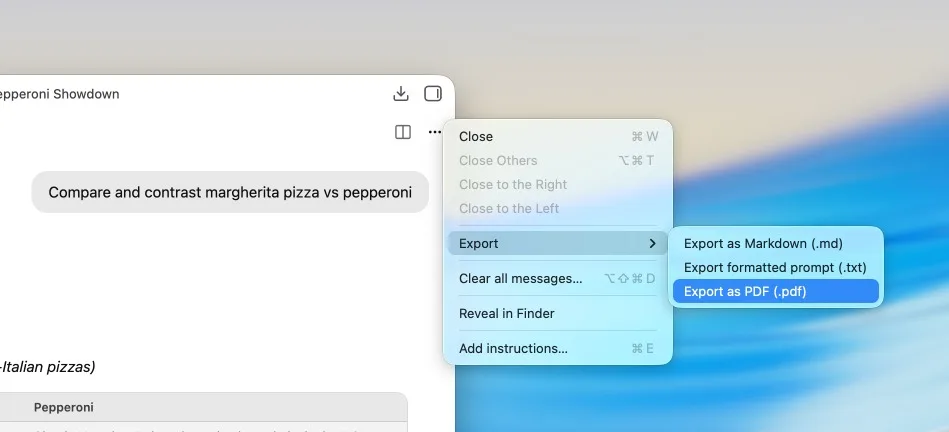

La experiencia de usuario no se ha olvidado: rediseño de la UI, exportación, vista dividida

Este cambio hacia «infra» podría haber sacrificado la comodidad. Por el contrario, la aplicación recibe un rediseño de la interfaz de usuario y funciones que son ideales para aquellos que trabajan realmente con un LLM a diario:

- Exportar conversaciones en PDF, Markdown o texto

- Vista dividida para abrir varios chats uno al lado del otro (útil para comparar prompts o trabajar en paralelo)

- Modo Developer y documentación integrada para hacer que la herramienta sea más comprensible

- Y un nuevo flujo CLI, con lms chat, para interactuar directamente desde la terminal

Por qué esta actualización es realmente importante

Detrás de la lista de características, LM Studio 0.4.0 ilustra un movimiento de fondo: la normalización de la IA local como una alternativa creíble a la nube, no solo por la privacidad, sino también por la integración del producto.

Para desarrolladores y responsables de productos, este es un paso más hacia un «stack» local donde el modelo se convierte en un servicio, consumible como una API. Para los equipos, es una señal: LM Studio quiere ser más que un cliente de chat; un componente que se puede integrar en CI, automatizar, asegurar y monitorizar. Finalmente, para el ecosistema, también es una respuesta al aumento de flujos de trabajo agentivos: ya no se trata solo de «hablar con el modelo», sino de orquestar llamadas en paralelo y conectar todo a otras herramientas.

En resumen: LM Studio se acerca a un territorio históricamente ocupado por soluciones más «desarrollador primero». Y lo hace sin renunciar a lo que ha cimentado su éxito: una capa de interfaz simple, casi de consumo masivo, para manejar modelos que a veces son todo menos simples.