Meta refuerza el control parental sobre la IA: una respuesta tardía… pero estratégica

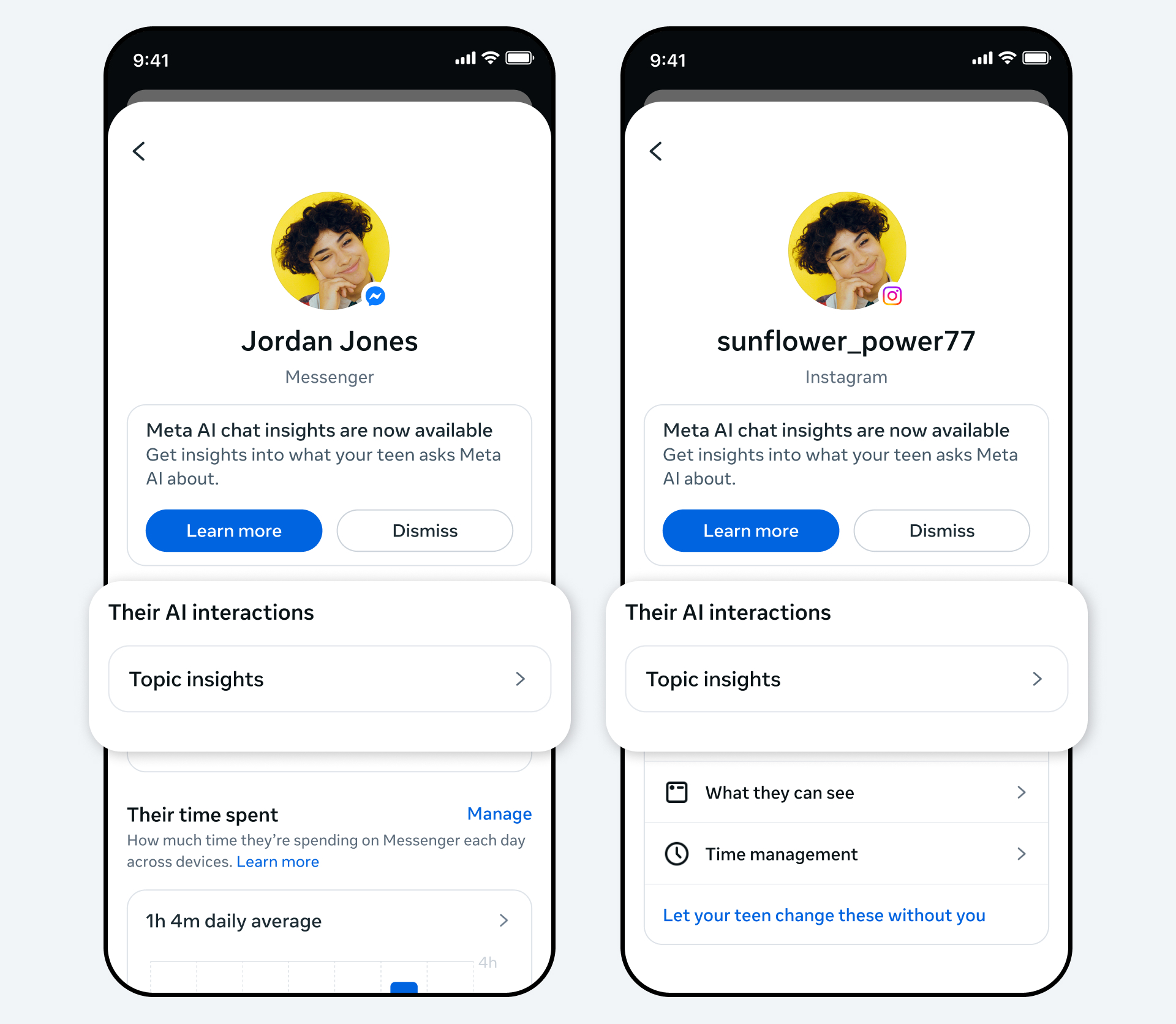

Después de meses de presión regulatoria y mediática, Meta comienza a estructurar una respuesta concreta en torno a la seguridad de los adolescentes frente a la IA. El grupo lanza una nueva funcionalidad llamada « Insights », integrada en su hub de supervisión en Instagram, Facebook y Messenger.

El objetivo es claro: brindar a los padres visibilidad —sin llegar a la vigilancia total— sobre las interacciones de sus hijos con la IA de Meta.

Visibilidad sin acceso directo a las conversaciones

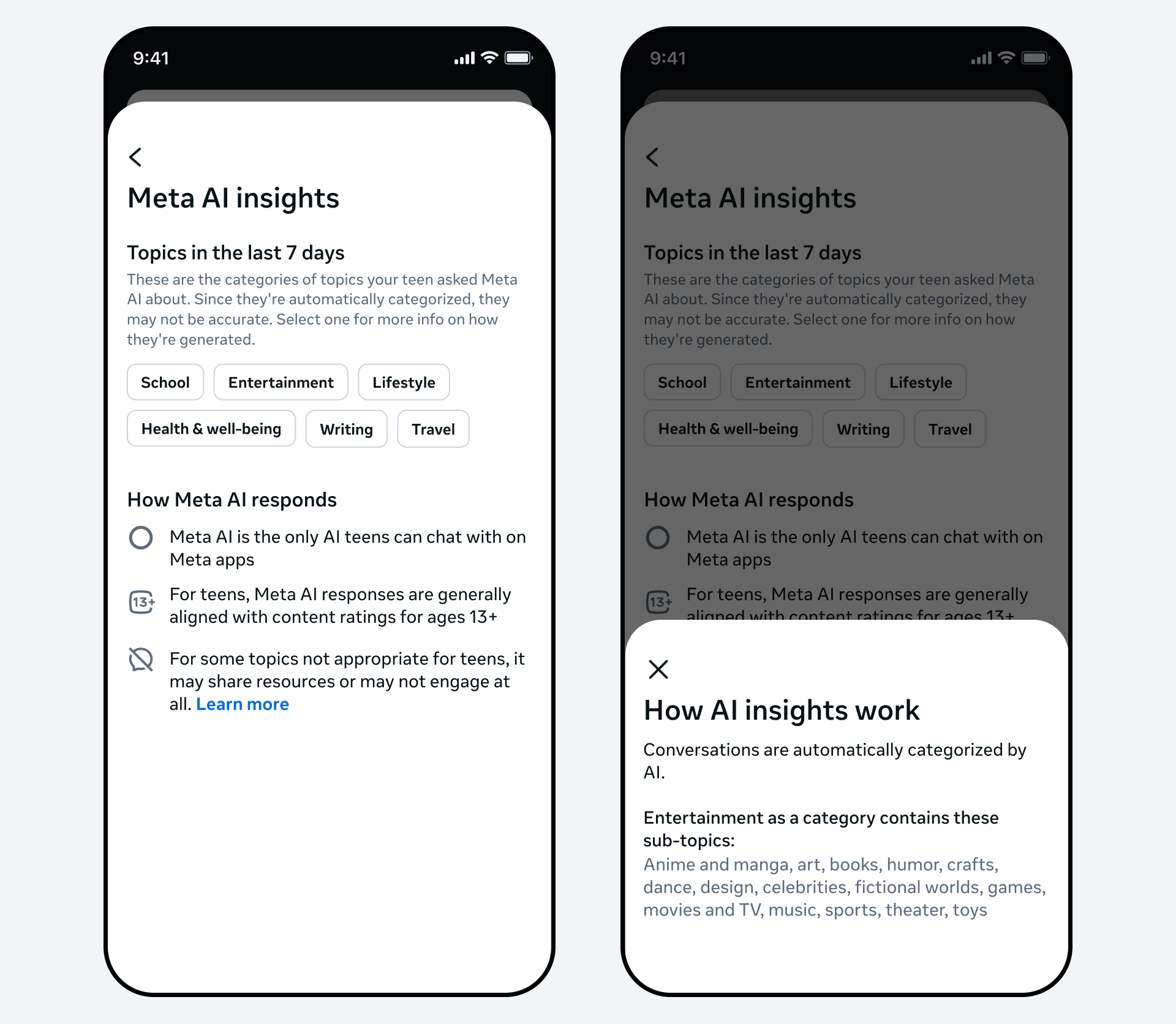

A diferencia de lo que algunos podrían temer, el sistema no otorga acceso a las conversaciones completas. En su lugar, Meta ofrece resúmenes semanales por temáticas.

De esta manera, los padres pueden ver si sus adolescentes interactúan con temas como: la escuela, el entretenimiento, el estilo de vida, los viajes o la salud y el bienestar. Cada categoría está subdividida, lo que permite identificar tendencias sin exponer el contenido exacto de los intercambios.

Esta elección no es casual. Meta intenta navegar entre dos exigencias opuestas: proteger a los jóvenes usuarios y respetar su intimidad digital.

En lugar de proporcionar un acceso directo a los mensajes, la empresa opta por una lectura contextual y agregada. Un enfoque que recuerda ciertas tendencias actuales en la moderación IA: detectar señales débiles sin monitorear cada palabra.

No obstante, este equilibrio sigue siendo frágil. Un control excesivo puede romper la confianza, mientras que uno insuficiente puede exponer a riesgos.

Controles más finos sobre el uso de la IA

Más allá de la simple visibilidad, Meta agrega herramientas de control: la posibilidad de limitar o desactivar ciertos personajes de IA, opción para bloquear las conversaciones con bots mientras se mantiene al asistente para usos neutros (deberes, preguntas cotidianas), o incluso la personalización del entorno de IA accesible para el adolescente.

Así, se pasa de una simple herramienta de vigilancia a una gestión activa de la experiencia de IA.

Hacia alertas sobre temas sensibles

Probablemente, esta sea la funcionalidad más importante —y también la más sensible. Meta está trabajando en un sistema de alertas dedicado a temas críticos. En caso de conversaciones relacionadas con la autolesión, la depresión severa o el suicidio, los padres podrían ser notificados directamente.

Si esta funcionalidad cumple con sus promesas, podría convertirse en un estándar de la industria, dado que la detección temprana de señales débiles es un tema crucial en los entornos digitales.

Un despliegue progresivo… bajo presión

Por el momento, esta funcionalidad está disponible en varios mercados clave: Estados Unidos, Reino Unido, Australia, Brasil y Canadá. Se espera un despliegue global en las próximas semanas.

Sin embargo, es difícil ignorar el contexto. Entre investigaciones, críticas sobre la seguridad de los jóvenes y la presión de los reguladores, Meta también actúa para responder a una necesidad política y legal. La colaboración con el Cyberbullying Research Center para ofrecer guías de discusión entre padres y adolescentes se inscribe en esta lógica.

Meta intenta retomar el control sobre un tema crítico

Este lanzamiento va más allá de una simple funcionalidad. Se inscribe en una batalla más amplia: la responsabilidad de las plataformas frente a la IA conversacional.

Con Insights, Meta introduce tres ideas clave:

- vigilar sin espiar,

- intervenir sin bloquear totalmente,

- alertar sin dramatizar sistemáticamente.

Queda por ver si este enfoque será suficiente. Porque, la verdadera prueba no será técnica, sino social: ¿los padres realmente utilizarán estas herramientas? ¿los adolescentes las aceptarán? Y, sobre todo, ¿serán pertinentes las señales detectadas?

Si Meta logra su objetivo, esta funcionalidad podría redefinir la manera en que las plataformas regulan el uso de la IA por menores de edad.

Pues en un mundo donde los adolescentes conversan tanto con agentes de IA como con sus amigos, la pregunta ya no es «¿debemos vigilar?», sino «¿cómo hacerlo inteligentemente?».