Google Ironwood: la TPU que marca el basculamiento hacia la era de la inferencia

Google no se limita a seguir la carrera de la IA; la está redefiniendo. Con la disponibilidad general de Ironwood TPU, presentada durante Google Cloud Next, la compañía introduce un chip diseñado principalmente para la inferencia.

Es un cambio estratégico significativo, en un momento en que el costo real de la IA ya no se centra en el entrenamiento, sino en la ejecución a gran escala.

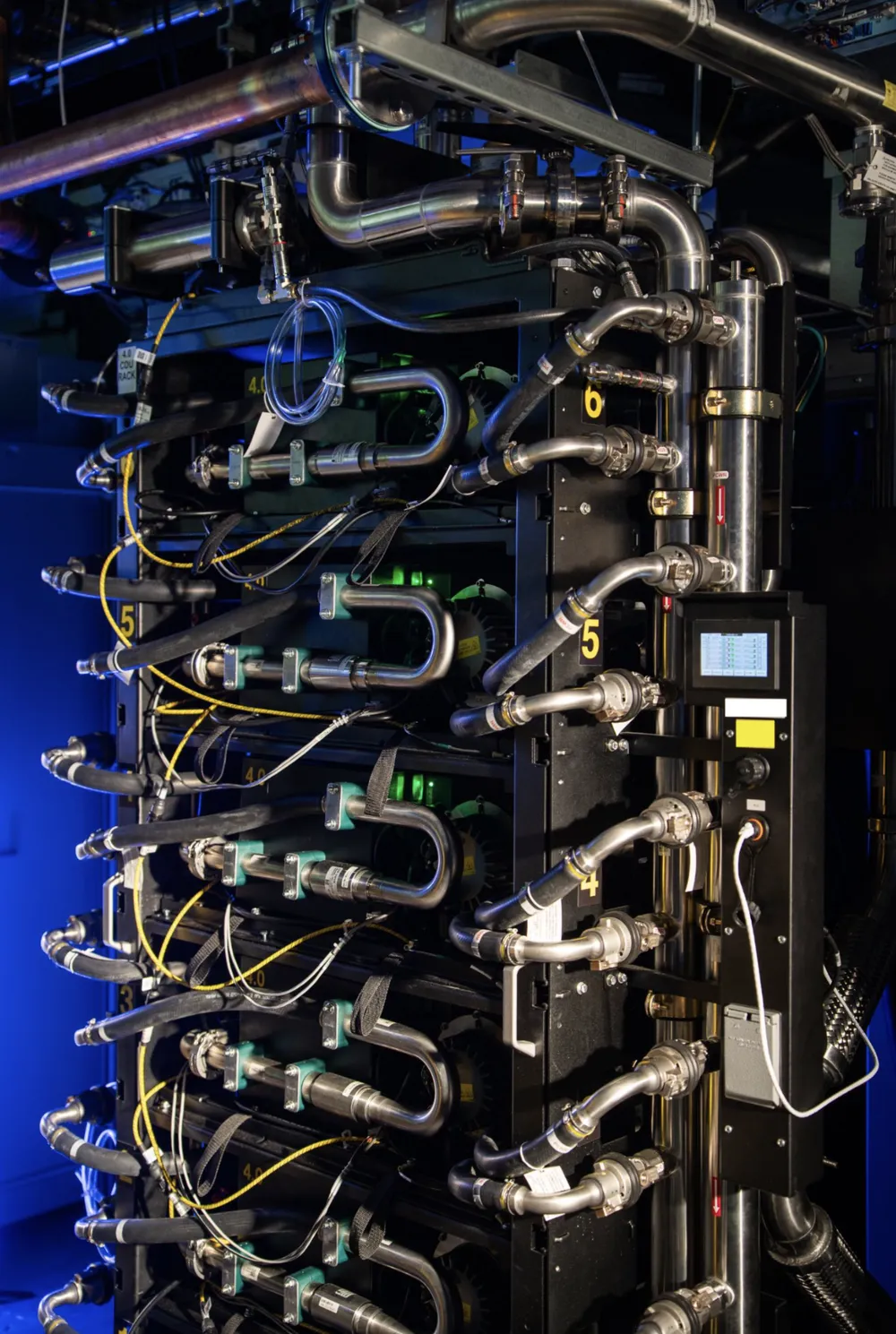

Ironwood: una demostración de fuerza técnica e industrial

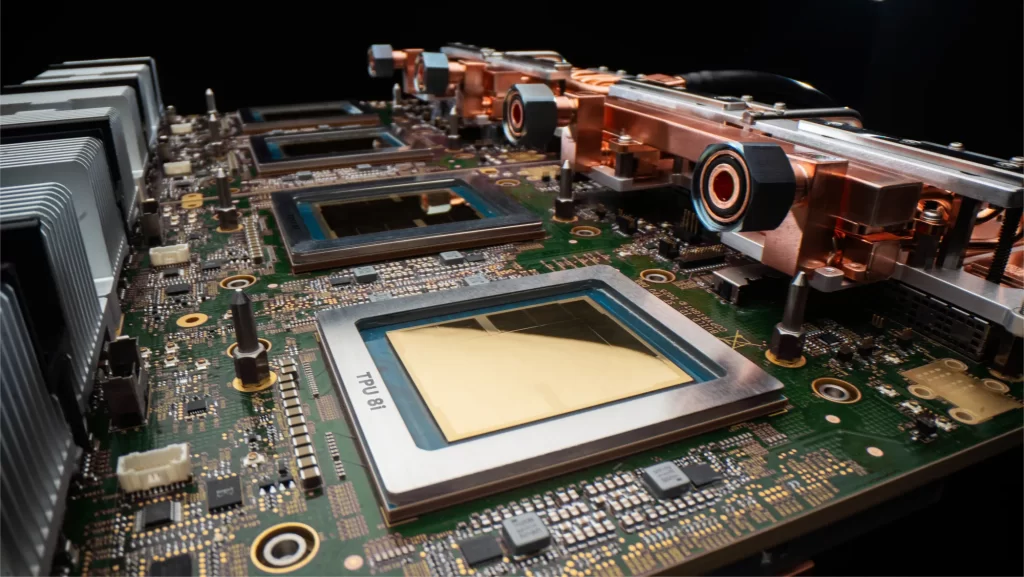

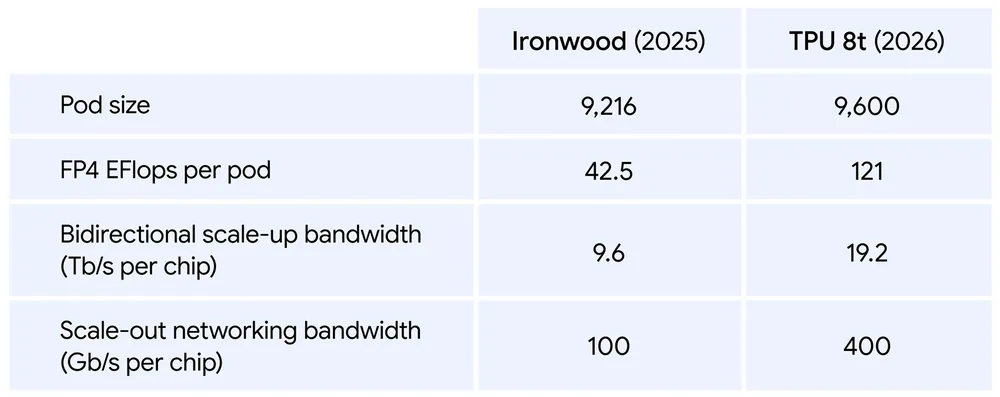

En teoría, Ironwood impresiona. Cada chip alcanza 4.6 pétaFLOPS en FP8, acompañado de 192 Go de memoria HBM3e y un ancho de banda de 7.37 To/s. Sin embargo, es a escala del sistema donde Google impacta fuertemente: un superpod de 9,216 TPU puede entregar hasta 42.5 exaFLOPS, superando la potencia del supercomputador El Capitan.

En comparación, el Nvidia Blackwell B200 muestra rendimientos similares en cálculo bruto, con una ventaja en interconexión (NVLink) y soporte para FP4. No obstante, Google opta por otra estrategia: la optimización a nivel de clúster y una eficiencia energética mejorada.

¿Por qué Google se enfoca en la inferencia?

El enfoque en la inferencia no es casual. Entrenar un modelo es un gasto puntual, mientras que la inferencia implica un costo continuo, exponencial y estructural. Google ahora debe alimentar en tiempo real servicios como Gemini, Google Search, YouTube y Gmail.

Con este ritmo, la capacidad de inferencia debe duplicarse cada seis meses. En este contexto, quien controle el costo por consulta capturará la margen. Y es precisamente donde Google busca destacarse: no superando a Nvidia en todos los frentes, sino construyendo el hardware más rentable para sus propios usos.

Ironwood, por lo tanto, está diseñado para cargas dominantes: modelos de lenguaje, arquitecturas Mixture-of-Experts, modelos de difusión y aprendizaje por refuerzo.

Su alta memoria ayuda a reducir la fragmentación de modelos, limitando los intercambios entre chips, un factor clave para latencia y costos.

TPU 8: Google abandona el modelo único

La anuncio más significativo puede estar en otro lugar. Google ya está preparando el futuro con una octava generación de TPU, dividiendo por primera vez en dos arquitecturas distintas:

- TPU 8t (Sunfish): dedicado al entrenamiento, co-desarrollado con Broadcom

- TPU 8i (Zebrafish): optimizado para la inferencia, diseñado con MediaTek

Fabricadas en 2 nm en TSMC, estas chips estarán listas para 2027.

Este es un cambio importante. Hasta ahora, cada TPU debía equilibrar entrenamiento e inferencia, un compromiso técnico constante. Google reconoce una realidad de mercado: los dos usos son fundamentalmente incompatibles en términos de optimización.

Una estrategia industrial tentacular

Ironwood es solo la parte visible de un plan mucho más amplio. Google construye una cadena de suministro multi-socio: Broadcom para chips de alto rendimiento, MediaTek para variantes optimizadas a costo, conversaciones con Marvell Technology y colaboración con Intel. Todo ello respaldado por una inversión colosal: hasta 185 mil millones de dólares para 2026.

Y, sobre todo, un cliente clave: Anthropic, que podría utilizar hasta un millón de TPU y varios gigavatios de capacidad.

La guerra de la IA se convierte en una guerra de márgenes

Lo que revela Ironwood va más allá de las especificaciones técnicas. El mercado está cambiando: las GPU dominaron el entrenamiento, mientras que la inferencia se convierte en el verdadero centro de costos y los hiperscalers construyen sus propios chips. Como resultado, un desplazamiento masivo de valor. Los analistas estiman que los ASIC podrían representar el 45% del mercado de IA para 2028, con una posible erosión de la dominación de Nvidia en la inferencia.

Sin embargo, Nvidia mantiene una ventaja decisiva: su ecosistema de software, especialmente CUDA. Como resumió Jensen Huang: «Construir algo mejor no es tan simple».

Google no busca necesariamente «hacer algo mejor» en absolutos. Busca hacer algo más barato, a gran escala, para sus propias necesidades.

Hacia una IA industrial, optimizada como una red eléctrica

Ironwood encarna una transición silenciosa pero fundamental: la IA se convierte en infraestructura, comparable a la energía o las telecomunicaciones. En este modelo, el rendimiento bruto cuenta menos que el costo por consulta, la eficiencia energética y la escalabilidad.

Google ahora apuesta por una evidencia estratégica: el valor ya no será capturado por quien proporcione los chips, sino por quien los diseñe para su propio uso.

Y con dos arquitecturas de TPU en preparación, la empresa establece definitivamente el fin de un modelo único. La era de la IA generalista cede paso a una ingeniería especializada, segmentada e industrializada.