Microsoft Maia 200: La puce de 3 nm que quiere romper el monopolio de NVIDIA

Microsoft ya no se limita a alojar la IA: ahora quiere dar forma a la misma, desde el silicio hasta el servicio. Con Maia 200, su nuevo acelerador de IA grabado en 3 nm, el gigante de Redmond asume una ambición clara: recuperar el control sobre el costo, la disponibilidad y el rendimiento de la inferencia — y enviar un mensaje directo a Amazon y Google.

Un giro: Microsoft se atreve a la comparación directa

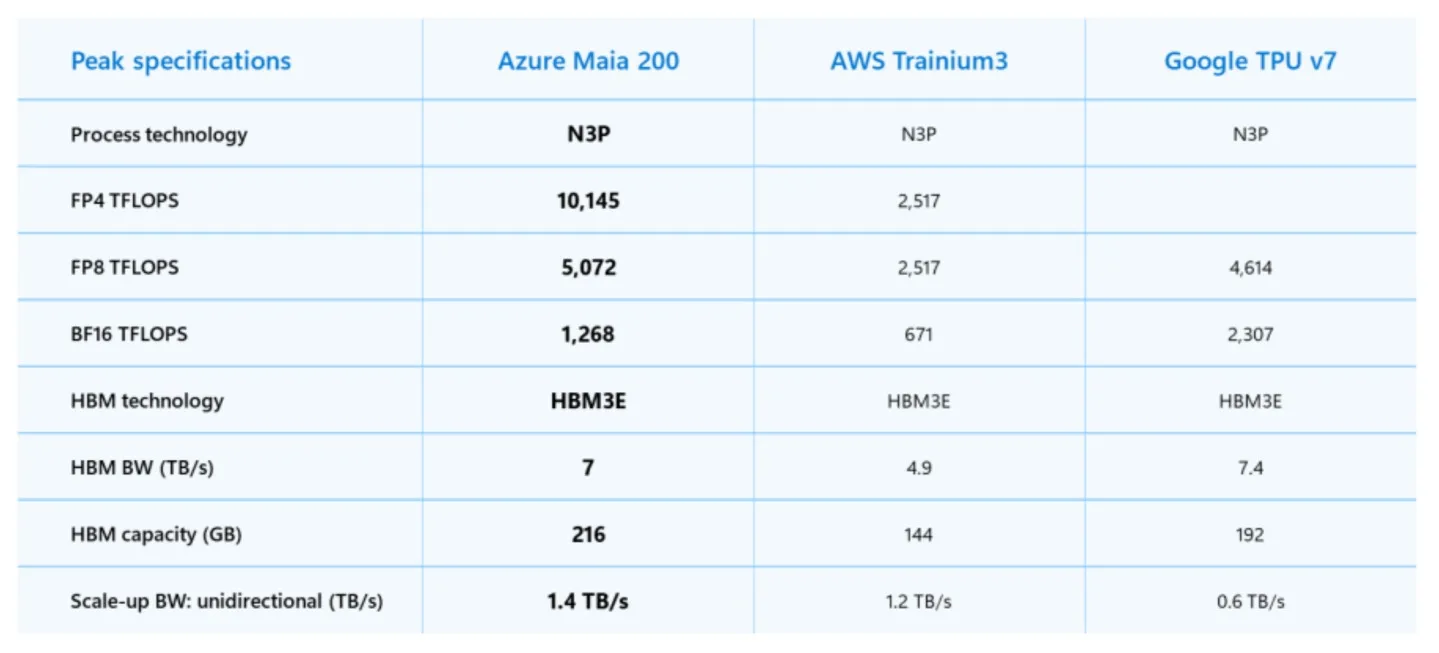

Hasta ahora, Microsoft había avanzado con cautela con Maia 100. Esta vez, el tono cambia. Maia 200 se presenta como un acelerador capaz de ofrecer 3 veces el rendimiento FP4 de la tercera generación de AWS Trainium, y un rendimiento FP8 superior al TPU v7 de Google.

Este posicionamiento no es baladí: en la guerra del cloud, las comparaciones públicas son una forma de diplomacia… y de disuasión.

Sobre el papel, Maia 200 cumple con todos los requisitos de un acelerador diseñado para la era de los grandes modelos:

- Fabricación TSMC 3 nm y más de 100 mil millones de transistores (algunos medios incluso mencionan ~140 mil millones).

- Un subsistema de memoria muy robusto: 216 Go de HBM3e y ~7 TB/s de ancho de banda, respaldado por 272 Mo de SRAM integrada.

- Un objetivo claro: «mejorar drásticamente la economía de la generación de tokens de IA, es decir, hacer la inferencia más barata a gran escala.

La promesa más estratégica puede que esté en otro lugar: Microsoft afirma lograr ~30% más de rendimiento por dólar que la generación más reciente de su parque.

En un mundo donde la IA se cobra por solicitud (y donde cada token cuenta), este tipo de ratio se convierte en un arma comercial.

La infraestructura ante todo: el anti-NVIDIA (sin decirlo)

Otro fuerte mensaje es la filosofía del sistema. Mientras que NVIDIA a menudo impone un modelo muy integrado en torno a sus interconexiones y racks, Microsoft enfatiza un enfoque que se basa más en Ethernet y una arquitectura de red «scale-up» propia.

Esta elección cuenta una historia: Microsoft quiere optimizar su cloud para sus cargas de trabajo — sin depender completamente del calendario (ni de los márgenes) de un único proveedor.

Despliegue: primero interno, pero con una puerta abierta a los desarrolladores

Maia 200 comienza allí donde realmente importa: en los centros de datos de Azure, con una primera disponibilidad anunciada en Azure US Central, y otras regiones que seguirán.

Microsoft también indica que sus equipos de «Superinteligencia» serán los primeros en beneficiarse — y que Maia 200 debe albergar, entre otros, los modelos GPT-5.2 de OpenAI dentro de su ecosistema.

Finalmente, Microsoft menciona un adelanto del SDK Maia 200 para desarrolladores y el mundo académico: una forma de crear un mínimo de ecosistema, donde NVIDIA reina precisamente gracias a CUDA y su inercia industrial.

La guerra del cloud se juega ahora a nivel de chips

Este lanzamiento llega en un momento muy particular: Amazon también está fortaleciendo su stack con Trainium, llegando incluso a integrar tecnologías de NVIDIA (NVLink Fusion) para robustecer la interconexión a escala de las «fábricas de IA».

Y, Google impulsa TPU v7 (Ironwood) como un bloque de inferencia diseñado para modelos de «reasoning» a gran escala.

En otras palabras, la competencia ya no se centra solo en «quién tiene el mejor modelo», sino en quién controla el costo total operativo — del silicio a la programación, de la memoria a las interconexiones, hasta el servicio facturado al cliente. Maia 200 es el intento de Microsoft de asegurar esta cadena.

Y si la promesa se cumple (rendimiento, eficiencia, disponibilidad, software), la cuestión va más allá de la ficha técnica: es un intento de convertir Azure en un lugar donde la IA sea más rentable — no solo «posible».