Ollama pasa a la velocidad superior en Mac: Gracias al framework MLX!

Los modelos locales están saliendo lentamente de su nicho de expertos, y Ollama está decidido a aprovechar este momento. La plataforma, que ya se ha convertido en un referente para ejecutar grandes modelos de lenguaje de forma local, ha anunciado un cambio particularmente estratégico: el soporte en previsualización del framework MLX de Apple, diseñado para utilizar de manera más eficiente los Mac equipados con chips Apple Silicon.

En línea con esto, Ollama también destaca una mejora en la caché y la llegada del soporte NVFP4 por parte de Nvidia para comprimir mejor ciertos modelos y reducir su huella de memoria.

En esencia, esta actualización sugiere algo más amplio que la mera optimización técnica. Muestra que la IA local ya no es solo un campo de experimentación para investigadores o aficionados. Está comenzando a convertirse en una respuesta válida, al menos para ciertos usos, a la creciente frustración por las suscripciones premium, las limitaciones de uso y los costos de los asistentes en la nube.

MLX, o la promesa de un Ollama finalmente adaptado para Apple Silicon

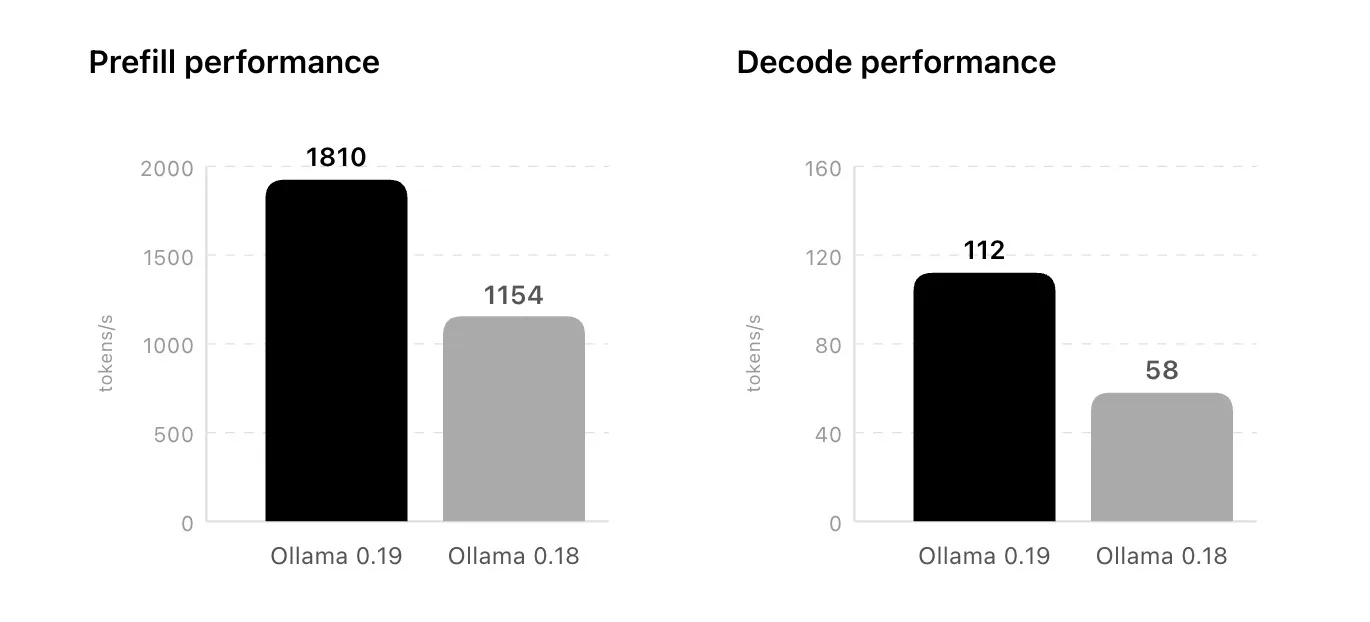

En su anuncio oficial del 30 de marzo de 2026, Ollama presenta MLX como «la manera más rápida» de ejecutar Ollama en Apple Silicon en previsualización. MLX es el framework de código abierto de Apple para machine learning, diseñado para aprovechar la arquitectura de memoria unificada de los chips propios. Ollama explica que esta integración tiene como objetivo precisamente aprovechar esta característica del hardware de los Mac recientes.

Este punto es crucial. Mientras que muchas herramientas de IA locales fueron inicialmente diseñadas en torno a máquinas con GPU dedicadas, MLX permite a Ollama adaptarse mejor a una lógica diferente, aquella de los Macs modernos donde CPU y GPU comparten memoria.

En términos claros, Ollama busca aquí no solo «portar» su runtime a Mac, sino realmente optimizarlo para la forma en que Apple concibe sus máquinas.

Una previsualización aún limitada, pero ya muy exigente

Por ahora, este soporte MLX sigue en preview en Ollama 0.19 y solo admite un modelo: la variante de 35 mil millones de parámetros de Qwen3.5 de Alibaba, en una versión orientada a código. Ollama también aclara que los requisitos de hardware son altos para un uso general: se necesita un Mac con Apple Silicon y al menos 32 GB de memoria.

En otras palabras, aún no estamos en una total democratización de la IA local en Mac. Hablamos más bien de un avance que beneficia primero a los usuarios que ya están bien equipados, especialmente a desarrolladores o creadores que han invertido en configuraciones robustas de Apple Silicon.

Los Macs más recientes son el centro de atención

Ollama también menciona que aprovecha los nuevos Neural Accelerators presentes en las GPU de la serie M5, lo que resulta en mejoras en el flujo de tokens por segundo y en el tiempo antes de la primera respuesta. Esto coloca de manera muy clara a los Macs más recientes en el centro de esta nueva etapa.

Este detalle no es menor. Confirma que la batalla de la IA local no solo se jugará en los modelos, sino también en la forma en que cada ecosistema de hardware expone sus aceleradores. Apple, que durante mucho tiempo fue visto como menos adecuado para este tipo de usos que las PC con GPU Nvidia, está empezando a convertirse lentamente en una plataforma más seria para la inferencia local.

NVFP4 y caché mejorado: Ollama optimiza también el otro frente, el de la memoria

El anuncio no se limita a Apple. Ollama también indica que soporta NVFP4, un formato de compresión relacionado con el ecosistema Nvidia, para mejorar la eficiencia de la memoria en ciertos modelos. Paralelamente, la empresa informa que ha revisado su rendimiento de caché. Juntas, estas optimizaciones deben permitir una ejecución más eficiente de modelos pesados, especialmente en máquinas con recursos limitados de memoria de video.

Esto es un desarrollo importante, ya que en la IA local, la verdadera barrera no es solo la potencia bruta. A menudo, es la capacidad de hacer que un modelo quepa en la memoria disponible, sin colapsar el rendimiento o requerir ajustes excesivos. En este sentido, Ollama continúa trabajando en el aspecto más concreto de la cuestión: hacer que la inferencia local sea menos restrictiva en términos de hardware constante. Esta interpretación se basa en las optimizaciones de compresión y caché anunciadas.

El contexto nunca ha sido tan favorable para la IA local

El momento de este anuncio es significativo. El éxito espectacular de OpenClaw ha vuelto a colocar a los agentes y modelos locales en el centro de la conversación. Los números exactos varían según las fuentes, pero varias publicaciones de prestigio lo describen como uno de los proyectos de código abierto más rápidos de la historia reciente, con más de 250,000 estrellas en GitHub a principios de marzo de 2026 y una adopción particularmente notable en ciertos círculos técnicos.

Paralelamente, Ollama sigue ampliando sus integraciones en el lado del desarrollo. Su documentación ahora muestra una conexión más clara con VS Code, donde los modelos de Ollama pueden utilizarse en el selector de modelos del chat IA.

Todo esto dibuja un nuevo panorama: los desarrolladores ya no ven solo los modelos en la nube como la única opción. Entre las limitaciones, el costo y la búsqueda de privacidad, muchos vuelven a preguntarse hasta qué punto una máquina local puede ser suficiente.

Los modelos locales siguen detrás de los mejores servicios en la nube, pero la brecha se vuelve menos descalificante

Hay que mantener la cabeza fría. Los modelos locales más accesibles siguen estando en general por detrás de los mejores modelos en la nube en los benchmarks más exigentes, y la configuración sigue requiriendo un cierto nivel técnico. Ollama, en sí mismo, sigue siendo principalmente una herramienta de línea de comandos, aunque existen otras interfaces que giran en torno a ella.

Pero el punto interesante está en otro lugar. Para ciertas tareas específicas —generación de código, asistencia privada, prototipado, redacción técnica, automatizaciones locales—, los modelos integrados comienzan a volverse «lo suficientemente buenos» como para evitar una suscripción adicional o al menos reducir la dependencia a un servicio externo.

Un avance prometedor, pero aún en construcción

Ollama no ha dado un calendario para el lanzamiento de este soporte MLX fuera de la previsualización ni para su extensión a más modelos. En este momento, por lo tanto, se trata de una fuerte señal, pero no de un cambio total.

Sin embargo, el mensaje es claro: la IA local en Mac ya no es una curiosidad. Con MLX, Ollama comienza a transformar Apple Silicon en un terreno más creíble para la inferencia moderna. Y a medida que los costos de la nube irritan a más desarrolladores, este tipo de optimización podría contar mucho más de lo que parece hoy.