OpenAI: Prompts de seguridad de código abierto para proteger a los adolescentes

OpenAI continúa su transición hacia una inteligencia artificial más regulada para los jóvenes. Esta semana, la empresa anunció la publicación de un conjunto de políticas de seguridad para adolescentes, formuladas como prompts, para ayudar a los desarrolladores a integrar más fácilmente protecciones adecuadas en sus aplicaciones.

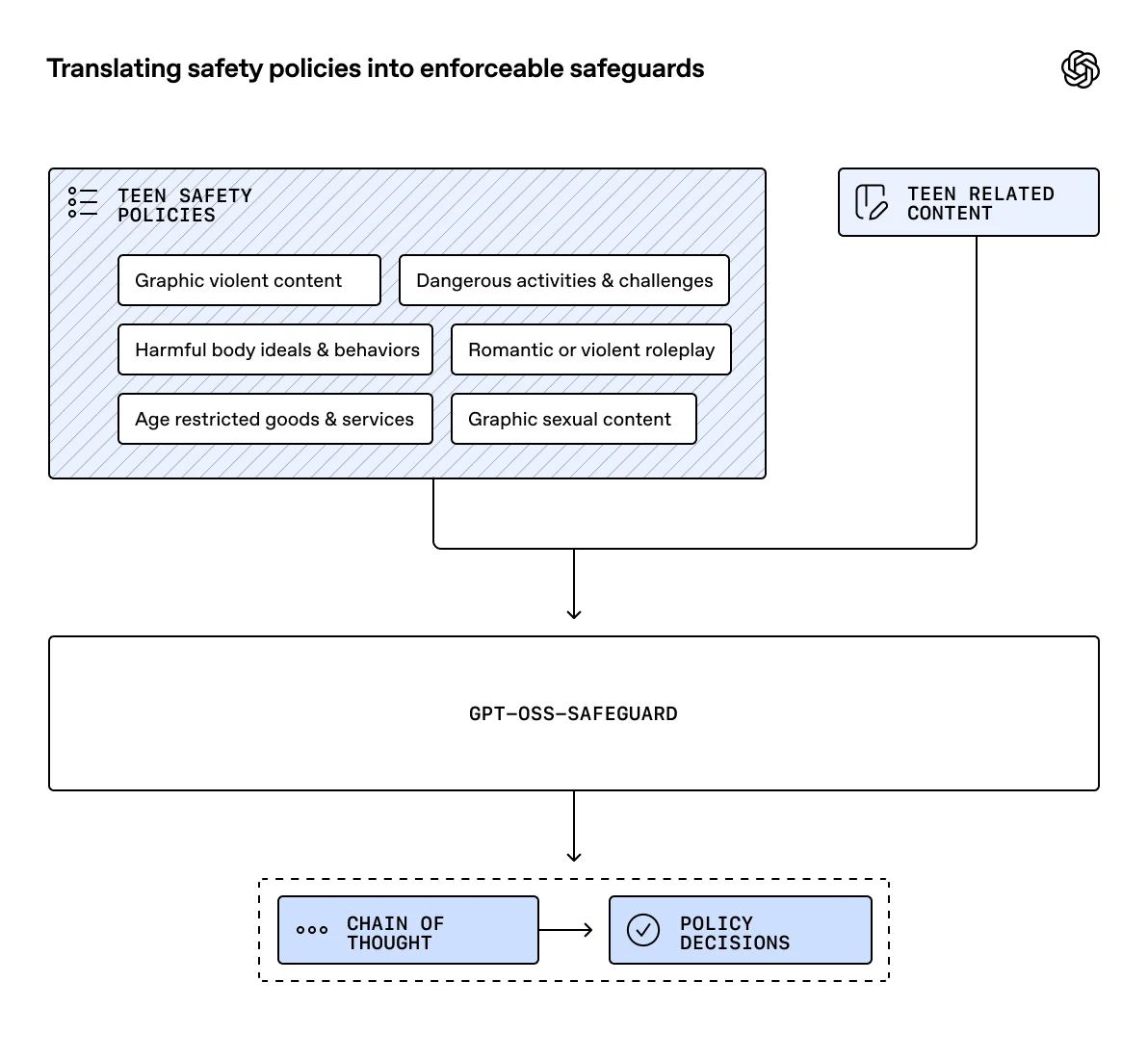

Estas reglas están diseñadas para funcionar con gpt-oss-safeguard, el modelo open-weight de seguridad de OpenAI, y también, en teoría, con otros modelos que sean compatibles con este enfoque.

Intento de transformar los principios de seguridad en reglas aplicables

El punto de partida es bastante simple: muchas equipos saben que deben proteger a los usuarios menores, pero todavía tienen dificultades para traducir esta intención en reglas operativas, coherentes y utilizables por un sistema de inteligencia artificial. OpenAI lo reconoce explícitamente en su publicación: incluso los desarrolladores experimentados encuentran dificultades al definir políticas precisas, bien estructuradas, que no sean ni demasiado laxas ni demasiado estrictas.

Para abordar este problema, OpenAI publica un conjunto de prompts que abordan varias categorías de riesgos para los adolescentes: violencia gráfica, contenido sexual explícito, ideologías corporales nocivas y comportamientos asociados, actividades y desafíos peligrosos, roleplay romántico o violento, así como bienes y servicios restringidos por edad. Estas políticas pueden servir para filtrar en tiempo real y analizar después los contenidos generados por los usuarios.

Un formato basado en prompts que ilustra la estrategia de OpenAI

La elección del formato no es casual. En lugar de ofrecer únicamente un modelo cerrado, OpenAI propone políticas expresadas como instrucciones reutilizables. Esto las hace más fáciles de adaptar a diferentes casos de uso, traducir, evolucionar y conectar con otros sistemas de moderación. La empresa indica que publicará este trabajo en código abierto a través de la Comunidad de Modelos ROOST, con la idea de fomentar contribuciones e iteraciones a lo largo del tiempo.

Este enfoque revela algo importante sobre la fase actual del mercado. OpenAI no solo busca vender modelos más poderosos; la empresa también quiere establecer bloques metodológicos, casi estándares de seguridad que sean reutilizables para el ecosistema. Esta interpretación es una inferencia, pero es coherente con el hecho de que estas políticas sean abiertas, adaptables y diseñadas para ir más allá del simple ámbito de gpt-oss-safeguard.

Common Sense Media y everyone.ai contribuyeron al diseño

OpenAI especifica que desarrolló estas políticas con el apoyo de organizaciones externas, incluyendo Common Sense Media y everyone.ai. Robbie Torney, de Common Sense Media, explica que este tipo de políticas «basadas en prompts» puede ayudar a establecer un nivel mínimo de seguridad más coherente en todo el ecosistema, mientras que, al mismo tiempo, son mejoradas con el tiempo gracias a su naturaleza de código abierto.

Este punto es crucial, ya que la cuestión de la protección de adolescentes no se limita a una capa técnica. También requiere la integración de conocimientos educativos, psicológicos y sociales que los laboratorios de IA no siempre poseen por sí solos. OpenAI parece estar en la búsqueda de mostrar que no construye estas salvaguardias en un ámbito cerrado.

Una pieza adicional en una estrategia más amplia en torno a los menores

Este anuncio no llega de la nada. En diciembre de 2025, OpenAI ya había actualizado su Especificación de Modelos con principios Under-18, para definir mejor el comportamiento esperado de sus modelos con respecto a los usuarios de 13 a 17 años. La compañía presentó estos principios como un marco para fomentar interacciones más seguras y adecuadas a cada edad.

OpenAI también ha implementado recientemente dispositivos más orientados a productos, como controles parentales y sistemas de estimación de edad en ChatGPT, tras un aumento de la presión pública y regulatoria sobre el uso de chatbots por parte de menores. Reuters informó en septiembre de 2025 que la empresa estaba lanzando estas herramientas en un contexto de fuertes críticas sobre los riesgos asociados, especialmente después del suicidio de un adolescente en California, cuya familia demandó a OpenAI.

Un avance útil, pero lejos de ser una solución definitiva

Sin embargo, es importante mantener una perspectiva equilibrada. Estas políticas no resuelven por sí solas el problema de la seguridad de los jóvenes frente a la IA. Constituyen una base, no una garantía absoluta. OpenAI misma presenta esta publicación como un paso entre otros, y no como una respuesta completa a todos los riesgos.

Además, el contexto sigue siendo delicado para la empresa. OpenAI todavía enfrenta litigios relacionados con usos extremos de ChatGPT. Reuters informó en agosto de 2025 sobre una demanda presentada por los padres de un adolescente que se suicidó tras intercambios prolongados con el chatbot y, en diciembre de 2025, otra que vinculaba a ChatGPT con un asesinato-suicidio.

OpenAI busca normalizar la seguridad antes de que los reguladores la impongan en todas partes

Lo más interesante de este anuncio podría ser exactamente eso. OpenAI parece entender que la próxima batalla no solo se librará en torno al rendimiento de los modelos, sino sobre la capacidad de transformar la seguridad en infraestructura reutilizable. Ayudar a los desarrolladores independientes y a los equipos de productos a partir de un marco ya estructurado también es una forma de difundir su propia visión de lo que debería ser una IA «compatible con adolescentes».

En resumen, OpenAI no propone aquí una revolución visible para el público general. La empresa establece más bien una base sólida. Y en un sector donde la seguridad todavía se improvisa con frecuencia después del hecho, este tipo de herramienta discreta podría tener un impacto mucho mayor que un simple anuncio.