ChatGPT puede revelar tu personalidad: un estudio reaviva el debate sobre la privacidad de las IA

Cada conversación con un chatbot puede parecer inofensiva. Sin embargo, un nuevo estudio de la ETH Zurich demuestra que nuestros intercambios con ChatGPT pueden ser suficientes para deducir ciertos rasgos de personalidad con una precisión superior al azar.

Tus mensajes dicen más de lo que crees

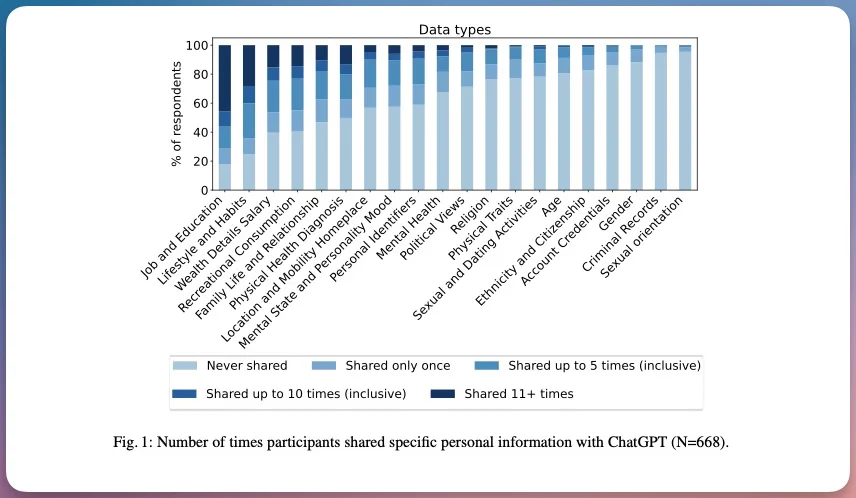

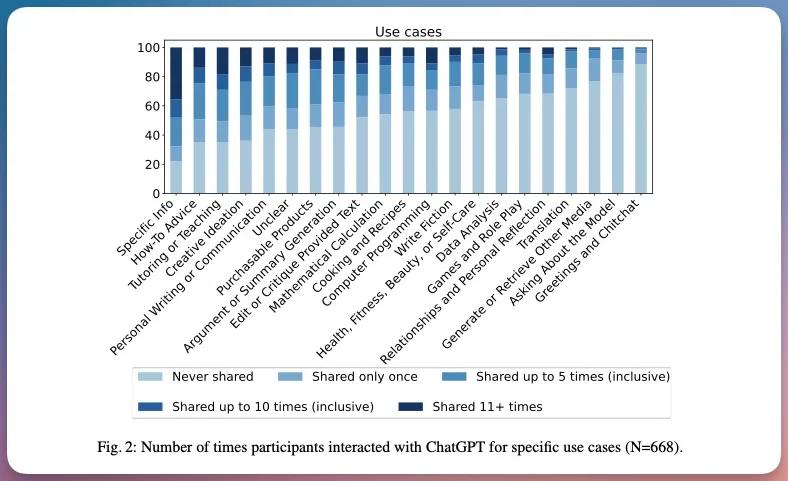

Investigadores de la ETH Zurich analizaron 62,090 conversaciones reales provenientes de 668 usuarios de ChatGPT. Los participantes también completaron una prueba de personalidad basada en los cinco grandes rasgos: apertura, escrupulosidad, extraversión, amabilidad y neuroticismo.

Los investigadores entrenaron luego un modelo RoBERTa para clasificar a los usuarios según estos rasgos. El resultado: el sistema supera al azar en varias dimensiones, con un rendimiento especialmente notable para la extraversión, alcanzando hasta un 44% de mejora relativa en ciertos tipos de intercambios.

ChatGPT: El tema de conversación lo cambia todo

El estudio indica que ciertos temas exponen más a los usuarios. Las discusiones relacionadas con la salud mental, las relaciones personales, la religión o el estado de ánimo contienen señales útiles para perfilar a una persona. Incluso las conversaciones cotidianas pueden volverse reveladoras cuando se acumulan.

Aquí es donde el riesgo se vuelve estructural: cuanto más se utiliza un asistente de IA, más material se le proporciona para entender nuestras costumbres, vulnerabilidades, preferencias y manera de razonar.

Un desafío importante para la publicidad y la persuasión

El problema no es solo académico. Un perfil psicológico puede utilizarse para personalizar una interfaz, pero también para dirigir una publicidad, orientar un mensaje o afinar una estrategia de influencia.

En un momento en que los asistentes de IA se convierten en compañeros de trabajo, de investigación, de confidencias y, a veces, de apoyo emocional, la línea entre la personalización útil y la manipulación potencial se vuelve mucho más difusa.

Un chatbot no es un diario íntimo

Este estudio recuerda una verdad que el uso diario puede hacer que se olvide rápidamente: un asistente de IA no es un cuaderno privado. Puede recibir confidencias, pero estos intercambios siguen siendo datos digitales, procesados dentro de un marco técnico y comercial.

La mejor defensa sigue siendo la moderación: evitar compartir información demasiado sensible, eliminar regularmente el historial cuando sea pertinente y tener presente que un chatbot a veces entiende más de lo que le preguntamos.